当地时间3月24日,从半导体IP厂商转型而来的Arm公司终于突破了其原有的产品矩阵和商业务模式,首次将产品矩阵延伸至量产芯片产品领域,正式发布了一款由 Arm 自主设计、面向人工智能 (AI) 数据中心的CPU——AGI CPU,旨在满足日益增长的代理式 AI (agentic AI) 工作负载需求,这一点从其“AGI ”(Agentic AI,代理型人工智能)的命名就能看出。互联网巨头Meta已经确认将是AGI CPU的首批客户。

Arm为什么要自研数据中心CPU?

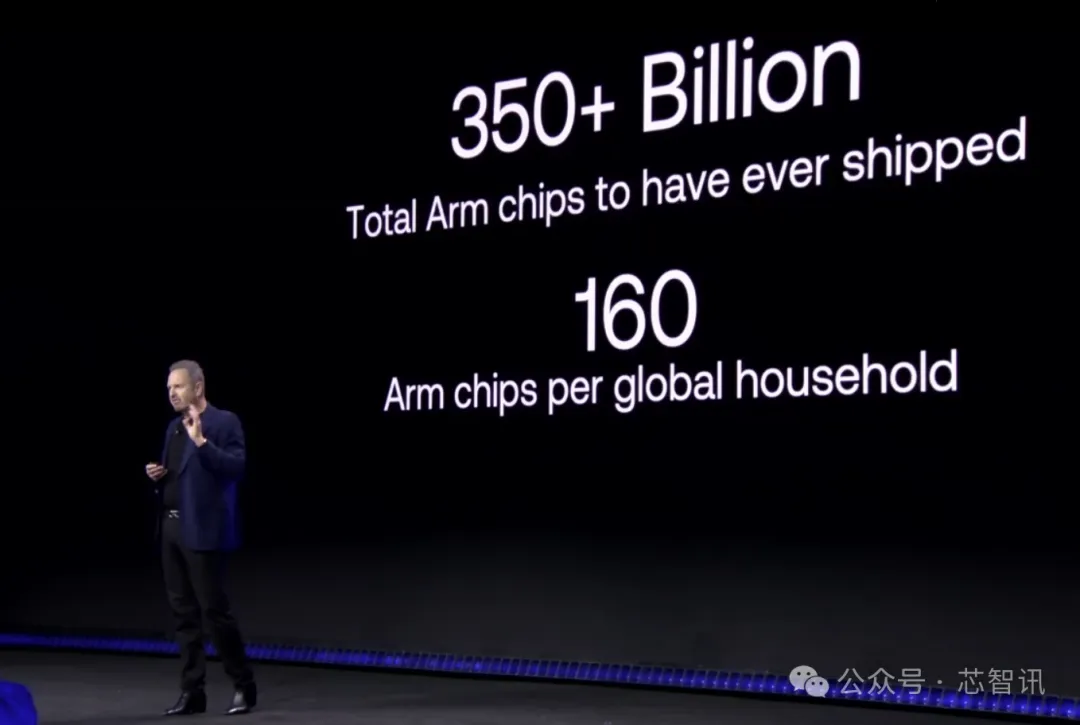

近三十多年来,Arm作为全球最大的半导体IP提供商,为全球数千亿台设备提供了可扩展、高能效的计算能力。根据Arm在发布会上公布数据显示,目前基于Arm架构的芯片累计出货量已超过3500亿颗,全球每个家庭的 Arm 芯片数量平均达到了160个。

Arm过去的“授权+版权”的独特商业模式在半导体行业家喻户晓,其毛利率虽然接近98%,但收入规模受限于芯片厂商的授权量和芯片单价,营收规模一直也比较小,其2024自然年的营收还不足30亿美元。

因此,为了提升业务规模,Arm在2023年就推出了计算子系统(CSS),这是针对客户的需求来发展类似半定制化的IP整合包服务(预集成更多经验证的Arm IP)。Arm希望通过结合更高技术含量的CSS技术等平台产品,提高利润率,并提高其在每个芯片上收取的版税,来扩大收入并提高利润。在CSS业务的推动下(目前CSS收入在营收中的占比已经达到了20%),Arm在2025自然年的营收刚刚突破了40亿美元,但是这仍远低于其众多主要芯片客户的收入。

现任 Arm CEO就任后,一直在努力推动Arm突破现有的商业模式,不断探索通过打造基于Arm IP的完整芯片解决方案,直接向客户销售自研的物理芯片,达到根本性的营收提升。

另一方面,Arm也观察到,随着 AI 正在重塑全球计算基础设施,数据中心对于CPU的需求正在高速增长。十多年前的云计算服务都是基于CPU的,随着AI时代的到来,数据中心也开始进入基于GPU和AI加速器的加速计算时代,随着AI数据中心的建设高速增长,这对于CPU需求也在快速增长。目前,1吉瓦的数据中心就需要3000万个CPU核。

特别是随着AI需求由训练转向推理,AGI(Agentic AI,代理型人工智能)时代的到来,AI系统需要大规模、持续运行,自主完成复杂任务的规划与执行,这意味着对于数据中心的协调与调度的算力需求将会指数级增长。比如,近期OpenClaw等Agent产品的爆发,让数据中心对算力的需求出现明显拐点。Agent的工作方式与传统AI推理存在本质区别:它需要7×24小时运行,而非单次响应请求;能够自主完成多步骤任务的规划与执行;并可与外部系统、API、用户进行复杂交互。

这些特性对CPU提出了全新要求:低延迟、高并发、可预测的性能表现,以及极致的能效比。因此,数据中心的算力需求正在发生结构性变化——CPU重新成为决定整个系统效率的关键。

根据Arm的预测,在当前传统数据中心架构下,每1吉瓦的数据中心算力,对CPU的需求的是3000万个CPU核。而在AGI时代,每1吉瓦的数据中心算力,对CPU的需求将会增长到1.2亿个,达到目前的约4倍。在此背景之下,对于数据中心的能源需求也将飙升,这对于CPU的能效表现也带来了更高的要求。而在数据中心市场,Arm CPU的高能效表现也正是其与x86 CPU竞争的关键优势。

正是这一需求上的变化,也推动了Arm突破其原有的产品矩阵和商业模式,在原有 IP、CSS计算子系统业务基础上,新增 Arm 自主设计的芯片产品,并且一开始瞄准的就是在AI浪潮之下高速增长且利润丰厚的数据中心CPU市场。

Arm 首席执行官 Rene Haas 表示:“AI 从根本上重塑了计算的构建与部署,代理式计算正进一步加速这一变革。今天标志着 Arm 计算平台迈入全新发展阶段,也成为公司发展的重要里程碑。随着Arm AGI CPU 芯片的推出,我们将基于 Arm 高性能、高能效的计算基石,为合作伙伴提供更多选择,助力代理式AI 基础设施实现全球规模化部署。”

AGI CPU:136个Neoverse V3核心,功率300瓦

作为Arm首个面向数据中心的自研CPU,AGI CPU基于台积电3nm制程,单个AGI CPU最多可支持136个Neoverse V3核心,主频3.2 GHz,最高频率3.7 GHz,每线程独立核心,可在持续负载下提供确定性性能,避免降频与线程闲置。这136个核心分布在两个小硅芯上,TDP在300瓦左右。

需要指出的是,Neoverse V3核心是Arm在2024年推出的新一代面向数据中心的CPU内核IP,集成于Neoverse CSS V3。而Arm AGI CPU之所以选择Neoverse V3核心,关键在于其面向AI做了非常大的改进,最多配备了八个128 位向量计算单元,在人工智能数据分析(AI data analytics)方面,性能相比Neoverse V2大幅跃升了84%。

在内存和接口支持方面,AGI CPU它支持 12 通道 DDR5 内存,最高可达 8800 MT/s,可提供超过 800 GB/s 的总内存带宽,或每核心 6GB/s的带宽,延迟低于100ns。I/O包含96条PCIe Gen6通道,并原生支持CXL 3.0以实现内存扩展和池化。

Arm表示,基于以上特性,AGI CPU能够实现更高的工作负载密度,更优的加速器利用率,并在现有功耗预算内释放更多可用算力。在 AI 基础设施持续扩展的过程中,这些都是至关重要的优势。

在具体性能表现上,根据Arm官方公布的数据显示,AGI CPU不论是单线程的持续性能、还是每机架的持续性能、以及每瓦特性能的表现上都远超X86 CPU平台。

Arm表示,AGI CPU 可实现单机架性能达到 x86 CPU平台的两倍以上。

在数据中心部署上,AGI CPU支持高密度 1U 服务器机箱的风冷部署方案,单机架可支持多达 8,160 个计算核心;同时也支持液冷系统,单机架可实现超过 45,000 个核心的部署规模。

Arm还推出了一个符合开放计算项目DC-MHS标准的10U双节点服务器

参考设计平台,每个刀片配置两颗AGI CPU,标准的风冷36kW机架可容纳30片刀片,共8,160个核心。Arm还与超微电脑(Supermicro)合作,开发了一款200kW液冷配置,拥有336颗AGI CPU和45,696个核心。

Arm还指出,基于Arm AGI CPU,每1吉瓦 AI 数据中心算力的资本支出 (CAPEX) 相比x86 CPU平台可节省高达 100 亿美元。

此外,Arm还披露了AGI CPU的路线图,2027年将会推出基于CSS V4的

AGI CPU 2,之后还将推出基于CSS V5的AGI CPU 3。

Meta成为首家客户,数十家合作伙伴入局

作为 Arm AGI CPU 的早期合作伙伴及联合开发者,Meta 利用该代理式 AI CPU 优化其全系应用的基础设施,并与其自研的 Meta 训练与推理加速器 (MTIA) 协同部署,从而在大规模 AI 系统中实现更高效的编排与调度。双方承诺将围绕 Arm AGI CPU 的多代芯片产品展开长期深度合作。

更值得关注的是,Meta计划在今年晚些时候通过Open Compute Project(OCP)开源AGI CPU的板卡和机架设计。这意味着其他厂商可以基于Meta的开源设计快速部署基于AGI CPU的服务器系统,这将极大加速该芯片的生态扩张。

Meta 基础设施负责人 Santosh Janardhan 表示:“要在全球规模化提供 AI 体验,需要一套稳健、可适配性的定制化芯片解决方案,专为加速 AI 工作负载、优化 Meta 全平台的性能而打造。我们与 Arm 携手开发 Arm AGI CPU,以部署一套高效的计算平台,在显著提升数据中心性能密度的同时,为我们持续演进的 AI 系统构建跨多代产品的技术发展路线图。”

除 Meta 外,Arm 已确认与 Cerebras、Cloudflare、F5 科技、OpenAI、Positron、Rebellions、SAP、SK 电讯等企业达成进一步的商务合作。这些客户将在代理式 CPU 核心应用场景中部署 Arm AGI CPU,覆盖加速器管理、控制平面处理、云与企业级 API、任务与应用托管等领域。

为加快产品落地与规模化部署,Arm 与永擎电子、联想、广达电脑、Supermicro 等头部 OEM 厂商及 ODM 厂商展开合作,早期系统现已推出,更广泛的商用部署预计将于今年下半年落地。

超大规模云服务商、云计算、芯片、内存、网络、软件、系统设计与制造等领域的 50 余家领军企业,均对 Arm 计算平台向芯片领域拓展表示支持。其中包括亚马逊云科技、博通、谷歌、Marvell、美光、微软、NVIDIA、三星、SK 海力士、台积公司等行业标杆企业。

目标市场将达1000亿美元

对于Arm来说,其突破原有商业模式,自研芯片来销售给终端客户,虽然能够快速增加新的收入来源,但是也将会带来成本的大幅提升、毛利率的下滑。并且还会出现与高通、联发科、谷歌、英伟达、亚马逊、微软等客户竞争的局面,这也确实可能会对其来自部分客户的未来收入造成一些负面影响。

Arm此前也曾表示,如果公司选择制造完整的芯片,它将蚕食公司的利润,并不能保证成功。因为,先进的人工智能芯片仅硅的制造的成本就高达5亿美元,支持它所需的服务器硬件和软件的成本可能更高。

不过,正如前面所提到的,Arm之所以亲自下场推出自研的CPU正是看到了AGI时代到来对于数据中心CPU的巨大需求。同时Arm目前的自研CPU也主要聚焦于数据中心市场,并不会与智能手机、汽车及物联网芯片客户产生竞争。所以,对于Arm现有客户的冲击是十分有限的。

另一方面,目前的Meta、亚马逊、微软等众多的云服务厂商本身就都有在自研基于Arm架构的数据中心CPU,而他们之所以选择自研,更多的也是出于一些定制化的需求和成本上的考量。如果Arm能够为他们提供符合他们需求的数据中心CPU,并且能够带来性能、能效、成本更优秀的解决方案,那么他们也就无需继续在自研数据中心CPU上投入更多的人力、物力和财力,这将会带来巨大的成本降低。更何况,他们目前的自研CPU很多也是与博通等第三方的芯片定制服务商合作推出的,而这些CPU本身就是基于Arm的IP。

Arm CEO Rene Haas也强调:“客户需求是推动公司做出这一决定(推出Arm AGI CPU)的重要原因。”这意味着,Arm并非要与客户抢生意,而是现有合作伙伴——尤其是超大规模云厂商——在AI算力爆发式增长的背景下,对定制化、高能效CPU的需求已经超出了单纯IP授权所能满足的范畴。

当然,对于Arm本身来说,推出自研的AGI CPU,直接向客户销售,将会迅速为Arm带来营收的大幅增长。要知道目前最贵的智能手机芯片也不过200美元左右(Arm通过版税收入所能拿到的就更低),而数据中心芯片的单价则可高达上万美元。

Rene Haas在发布会现场也直言,推出自研的AGI CPU芯片旨在“获得AI基础设施支出中更大份额”。在云数据中心的强劲发展态势,让Arm做过一个大胆的预估,Arm 架构将占据半数 2025 年出货到头部云服务提供商的算力。据悉,该目标在去年已经实现,但 Arm 的布局显然不止于此。在激烈的数据中心竞争中,想要撼动传统巨头地位、占据有利竞争优势并非易事,但随着 AGI CPU 的推出,这一目标有望逐步实现。

Rene Haas还预计,新自研CPU芯片业务到2030年的可用市场空间将高达1000亿美元,并且将会带动Arm整个的可用市场空间突破1万亿美元。

在此基础上,Arm预计,到2030年公司的自研芯片业务将会创造约150亿美元的年度营收,推动公司总销售额达到250亿美元,超过当前水平的五倍。

小结:

Arm AGI CPU的发布,标志着这家半导体IP巨头完成了从“幕后功臣”转向“台前巨头”的关键跃迁。

在AI基础设施支出持续膨胀的背景下,Arm决心跨出IP授权费和版税等IP与CSS的产品战略,而是选择直接参与万亿美元算力市场的价值分配。这一决策的风险显而易见——与现有客户的关系将变得更加复杂,竞争压力也急剧加大。

但Arm的赌注同样清晰:在Agentic AI时代,CPU的价值将被重新定义。那些能够提供极致能效、超高密度、可预测性能的CPU,将成为AI基础设施中不可或缺的算力底座。

正如Haas所言:“AI从根本上重新定义了计算的构建和部署方式。智能体计算正在加速这一变革,今天标志着Arm计算平台进入下一个阶段。”

目前,首批搭载Arm AGI CPU的服务器系统已在部分客户中投入使用,更大范围的商用部署预计将在2026年下半年展开。这场从幕后到台前的转型,其成败将决定Arm在未来十年AI算力版图中的最终位置。

编辑:芯智讯-浪客剑