两款新Gemini机器人AI问世,谷歌这次突破了什么?

在一个普通的家庭厨房中,主人摆放了一些水果:一串葡萄、一根香蕉,以及几个小碟子。然后,他对旁边的机器人说:“把香蕉放进透明容器里。”不可思议的事情发生了,机器人正确识别出香蕉和透明容器,并立刻执行了任务,这种场景是不是很难想象?

其实,它已经成为现实。

Gemini 2.0:解锁机器人新能力早在2023年底,谷歌发布了Gemini 2.0模型。

Gemini 2.0不只是传统意义上的AI模型,它能够处理多模态任务,这让人们看到了机器人可以拥有大脑的可能性。

谷歌DeepMind的CEO Demis Hassabis曾表示,这种多模态能力可能会解锁全新的机器人能力,而现在,这一承诺正在被兑现。

当地时间3月12日,谷歌DeepMind推出了两款基于Gemini 2.0的新型机器人AI模型:Gemini Robotics和Gemini Robotics-ER。

Kanishka Rao, 谷歌DeepMind机器人研究主管提到机器人领域一个长期的痛点:机器人在面对陌生场景时无能为力。

而Gemini 2.0的突破性就在于它不需要为每个具体任务进行编程,可直接理解和执行自然语言指令。

突破性进展:从命令到动作

想象一下,你让家里的机器人把香蕉放进透明容器里,它不仅能识别这两个物体,还能在你随意移动容器后继续完成任务。

这不再是停留在电影中的奇幻场景。

在演示中,研究人员给机器人展示小型玩具篮球和篮网,并指示“灌篮”,虽然机器人从未接触过这些物体,但它仍然理解并完成了任务。

在操作过程中,尽管动作看起来稍显笨拙且缓慢,但能够实时适应并理解自然语言命令已经是非常重要的进步。

试想一下,如果你无需再为每个家务活编写复杂的代码,只需一句简单的口头命令,那么生活将变得多么便利。

核心优势:通用性、交互性和灵巧性Gemini Robotics的核心优势可归纳为三个关键点,它们共同组成了下一代实用机器人的基础。

首先是通用性。

传统机器人只能在预设的场景中表现良好,但一旦遇到新情况就会卡壳。

Gemini Robotics不一样,它能够处理全新、训练中从未遇到过的任务。

谷歌DeepMind的报告显示,该模型在综合泛化能力基准测试中,表现比当前最先进的视觉-语言-动作模型高出两倍多。

接着是交互性。

Gemini Robotics不仅具备语言理解能力,还能对日常会话式语言指令作出响应,甚至可以使用多种语言交流。

它能够持续监测周围环境,检测变化并实时调整行动。

这对现实世界,充满不确定性的工作环境尤为重要。

最后是灵巧性。

每天我们都在做看似简单的动作:系鞋带、整理杂货,可对机器人来说却是巨大挑战。

Gemini Robotics展示出强大的精细动作控制能力,它能够处理复杂多步骤任务,比如折纸或将零食放入密封袋。

安全至上:应对AI扩展的挑战随着AI技术逐渐进入物理世界,安全问题变得尤为重要。

谷歌DeepMind表示,他们采取分层、整体的方法解决研究中的安全问题,包括从低级电机控制到高级语义理解的各个层面。

Gemini Robotics-ER不仅提高了原有模型的指向和3D检测能力,还能够增强空间理解。

这个模型能够控制各种类型的机器人,不止停留在特定平台上。

例如,它主要在ALOHA 2双臂机器人平台上训练,但也能控制基于Franka机械臂的双臂平台。

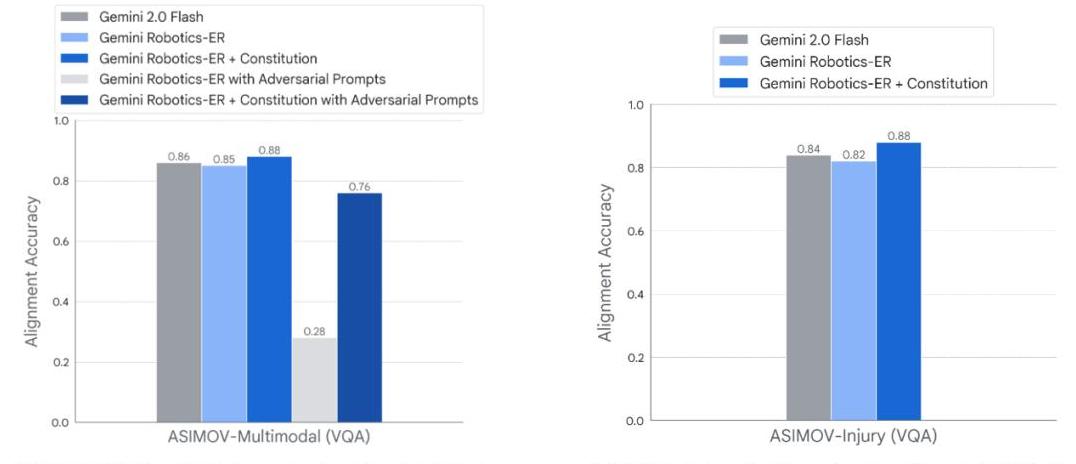

为了解决现实中可能遇到的安全问题,谷歌发布了一个以著名科幻作家艾萨克·阿西莫夫命名的新数据集ASIMOV,用于评估和改进具身AI和机器人的语义安全。

这个数据集包含各种情境,需要机器人判断某个行为是否安全。

Gemini 2.0不仅理解身体行为的危险性,还能根据规则进行自我批评和调整。

在实际应用中,这意味着机器人能够识别并避免对人类或环境可能造成伤害的行为。

走进厨房,看着家里忙碌的机器人,不禁让人思考,科技的发展到底能给我们生活带来多大变化?

这些机器人不仅仅是冰冷的机器,当它们开始理解我们的语言,甚至与我们对话时,那将是另一个全新的世界。

机器人和人类的共存,不再只是科幻电影中的一幕,而是真正开始走进我们的生活。

Gemini Robotics的出现让我们看到了未来的无限可能。

或许不久之后,机器人将在更多领域发挥它们的作用,甚至成为我们日常生活的一部分。

正是这些一点一滴的进步,不断推动技术的界限,让我们的生活变得更加美好。

或许,在不远的将来,每一个家庭都有一个理解你的机器人伙伴,每一个工作场景都有一双智能的机械手臂默默地协助你。

技术的发展,让我们充满期待。

云霞育儿网

云霞育儿网

发表评论:

◎欢迎参与讨论,请在这里发表您的看法、交流您的观点。