英伟达H200要解禁了。

12月8日,美国总统特朗普表示将允许英伟达向中国等市场的「经批准客户」出口H200 AI芯片,并称该安排将附带国家安全条件,由美国商务部落实具体审批与细则。

特朗普还提到美国将从相关对华H200交易中收取约25%的收入分成,这算盘打的噼哩啪啦响。

先不管这事儿后续会怎样,我们今天就来扒一扒,为什么看起来很牛的H200,却是最生不逢时的一代。

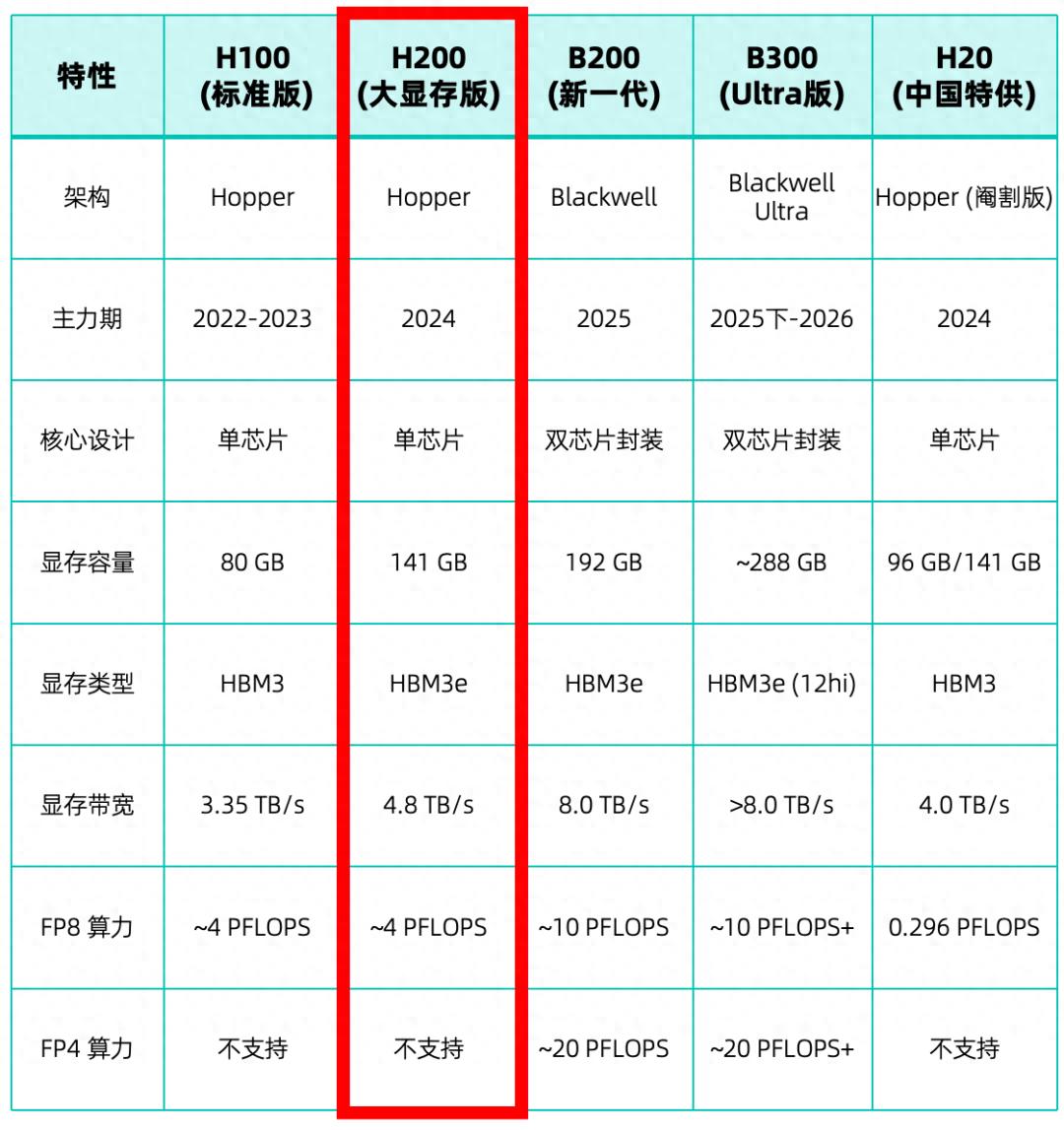

表1:英伟达历代AI GPU

表1:英伟达历代AI GPU其实,在这张表里,H200是处境最尴尬的。

虽然从技术参数上看,H200是H100的“完美升级版”(算力持平,但显存和带宽大幅提升),但在实际的市场占有率和声量上,H100依然占据统治地位。

这背后的原因并非H200不好,而是它处于一个尴尬的中间位置。

1. H200生不逢时这是最核心的原因。

前有H100先发:H100于2022年底/2023年初开始大规模交付,那时正是 ChatGPT爆发、全球疯抢算力的起点。几乎所有的大公司(Meta, Microsoft, OpenAI)都在那个时间窗口建立了庞大的H100集群。

后有Blackwell追兵:当H200终于在2024年中期开始铺货时,英伟达已经发布了下一代核武器Blackwell (B200/GB200)。

对于很多大厂来说,既然手里已经有几万张 H100 了,与其费劲升级到提升只有1.4倍的H200,不如跳过这一代,直接等提升4倍的B200。

于是嘛,嘿嘿,H200成了被很多客户「战略性跳过」的一代。

2. HBM3e产能瓶颈H200相比H100最大的卖点是采用了HBM3e内存,这是实现141GB显存4.8TB/s带宽的关键。

HBM3e是当时最新的存储技术,SK海力士和美光在初期的产能良率远不如成熟的HBM3。

能够生产出来的有限HBM3e颗粒,可能优先被分配给了利润更高、战略意义更大的Blackwell系列测试,结果导致H200的交付周期比H100更长。

结果,很多急需算力的客户宁愿买现货充足的H100,也不愿排队等H200了。

3. H200定位偏科H200的升级主要在显存。

如果干推理,H200堪称神卡。因为大模型推理最吃显存带宽,H200相比 H100能带来近乎翻倍的推理性能提升。

但是如果搞训练,虽然也吃显存,但更吃核心算力。而H200的计算核心和H100是一模一样的。

对于那些主要任务是「炼大模型」的公司,H200在核心训练速度上并没有质的飞跃,升级动力不足。

4. 能同构没人会异构智算中心不是积木,其实换卡很麻烦。

训练大模型要求几千张卡必须性能一致,你没法在一个全是H100的集群里随便插几张H200,这里面好比木桶原理,速度会被慢卡(H100)拖累,H200的额外显存和带宽无从发挥。

异构虽然是个方案,但那都是缺卡凑卡的无奈之举,为了保持集群的同构性,已经在用H100的客户扩容时,只能无奈继续买 H100,而不是买H200。

这么说吧H100像是开创者,吃到了大模型爆发的第一波最大红利。

B200则是储君,是大家都在等的下一个真命天子。

而H200呢?它是各夹在中间的「过渡者」。性能虽然比H100强,但生在了Blackwell即将发布的前夜,注定无法像H100那样铺天盖地。

所以所以,H200为什么能解禁?值得琢磨

。

声明:本文仅为信息交流之用,不构成任何投资建议,股市有风险,投资需谨慎。

评论列表