3月31日上午消息,阿里发布千问新一代全模态大模型qwen3.5-omni,宣布在音视频理解、识别、交互等215项任务中取得sota(性能最佳),超越gemini-3.1pro,成为目前全球最强的全模态大模型之一。

据悉,该模型拥有极强的音视频理解与实时交互能力,能够对音视频内容生成详细且可控的结构化描述,可识别语言和方言数量多达113种,还涌现出了音视频vibecoding能力,用户对着镜头阐述需求,就能让模型自主生成app、网页、游戏等复杂产品代码。目前,阿里云百炼已上新qwen3.5-omni的plus、flash、light三种api,可广泛应用于短视频/直播平台、游戏、自媒体等行业。

qwen3.5-omni采用混合注意力moe架构,在海量文本、视觉以及超过1亿小时的音视频数据上进行了原生多模态预训练,可实现图片、视频、语音、文字等全模态内容的输入与输出。新模型在音视频理解、跨模态推理、agent方面实现了性能飞跃,在音视频理解、语音识别、多语种翻译、对话等215项第三方性能测试任务中取得sota。

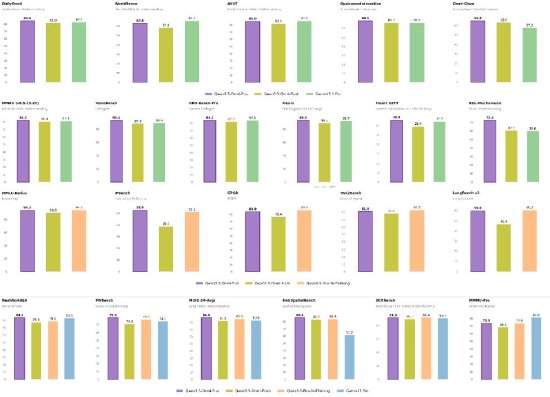

例如,在聚焦视听交互能力的dailyomni、qualcomminteractive、omnicloze等测试中,qwen3.5-omni得分领先gemini-3.1pro;在检测嘈杂环境抗干扰能力的wenetspeech测试中,qwen3.5-omni错误率远低于gemini,识别准确率极高;在考察多语言语音生成质量的multi-lingual(30lang)测试中,qwen3.5-omni同样显著优于gemini-2.5-pro-tts。

此外,与纯文本或图片驱动的vibecoding不同,千问还可以实现音视频编程:打开摄像头,用户对着草图口述需求,哪怕是包括复杂产品逻辑的描述,模型也能直接生成带有复杂ui的产品原型界面,真正实现“动动嘴即可编程”。这一能力并非刻意设计,而是模型在原生多模态能力持续扩展过程中自然涌现出的结果。

目前,普通用户也可前往qwenchat免费体验,开发者和企业可通过阿里云百炼平台调用qwen3.5-omni模型,每百万tokens输入不到0.8元,比gemini-3.1pro的1/10还低。