3月24日,谷歌研究院发布了一篇论文。

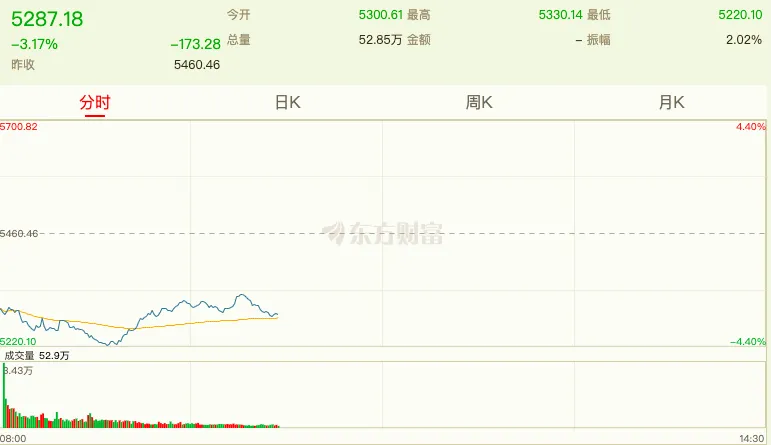

3月25日,全球存储芯片板块集体崩盘。

美光股价暴跌4.5%,SK海力士在韩国市场一度重挫6.2%,三星、西部数据、闪迪无一幸免。粗略估算,仅仅一天时间,这些存储巨头的市值蒸发了超过6200亿人民币。

3月26日,三星、海力士继续下跌行情……

而这一切的导火索,就是谷歌那篇看似平平无奇的论文——TurboQuant。

说实话,第一次看到这个新闻的时候,我也是一脸懵。一个算法而已,至于吗?

但当我深入了解之后,不由得拍案大呼:这哪是什么算法,这分明是一颗投向存储芯片行业的核弹。

今天,我们就来聊聊这个让全球内存巨头们彻夜难眠的TurboQuant,到底是什么来头。

一、先搞清楚一个问题:KV缓存是什么?

要讲清楚TurboQuant,得先了解一个基本概念——KV缓存。

简单的说,当你和AI聊天的时候,它之所以能"记住"你们之前的对话,靠的就是KV缓存(Key-Value Cache)。

每次你发送的消息,大模型都会把这条消息的"关键信息"(Key)和"具体内容"(Value)保存下来。这样一来当你继续提问时,它就能准确定位之前的对话,直接调用缓存就行。

这就像一个笔记本,帮你记住之前聊过的所有内容。

但问题来了——这个"笔记本"越记越多,占用的内存也越来越大。

假如你和AI聊了一万字的长文,KV缓存可能就占用几GB的显存。对于ChatGPT这种每天处理数亿次对话的系统来说,存储成本无疑是个天文数字。

这就是为什么AI推理这么贵的核心原因。不是算力不够,是内存不够。

二、TurboQuant到底做了什么?

谷歌的TurboQuant,本质上就是一套"压缩算法"。

但它厉害的地方在于:它把KV缓存压缩到了3比特,而且零精度损失。

传统的KV缓存通常用16比特来存储。TurboQuant直接把缓存砍到3比特,压缩率超过80%。

更夸张的是,压缩后的模型性能丝毫不打折扣。在英伟达H100 GPU上,推理速度最高提升了8倍。

内存占用减少6倍,推理速度提升8倍。这就是TurboQuant交出的成绩单。

用谷歌自己的话说,这是"逼近理论极限"的压缩技术”。

三、为什么存储芯片行业慌了?

现在你可以理解,为什么存储芯片股价会跌跌不休了。

过去两年,AI产业的爆发带火了一整条产业链。英伟达的GPU卖疯了,存储芯片也跟着水涨船高。为了抢占AI算力,各家都斥巨资抢购高带宽内存,美光、SK海力士、三星的内存产能早早就被它们瓜分干净,连带着股价都翻了几倍(可怜下游被动涨价的手机厂商,钱没挣到还被骂得狗血淋头)。

市场的逻辑很简单:AI越火,需要的算力越多,需要的内存也越多,尤其是高带宽的HBM内存,市场需求旺盛,价格自然上涨(一箱标准HBM内存,其价值堪比一线城市一套房)。

但TurboQuant的出现,直接打破了这个逻辑。

如果A用更少的资源能够完成同样的任务,那存储芯片的需求还会那么旺盛吗?

华尔街最怕的,不是竞争,而是"不再需要"。

谷歌用一篇论文告诉市场:你们之前押注的"AI必须配大内存",现在不需要了。

这项颠覆性技术的提出,证明了deepseek技术路线的可行性:用更少的内存,也能跑同样质量的推理。

四、但故事还没结束:技术突破≠行业终结

看到这里,你可能会觉得存储芯片行业要完蛋了。

但事情没那么简单。

首先,TurboQuant目前还只是停留在研究阶段,距离大规模商用还有很大一段距离。技术落地需要时间,存储芯片的短期需求不会立刻消失。

其次,更高效的AI可能会催生更多应用场景。就像5G提速催生了短视频一样,AI推理成本的大幅降低,可能会带来新的爆发式增长点。到时候,存储芯片的总需求或许会不降反升。

而且这项技术目前只解决了推理阶段的内存问题,更加消耗算力的AI算力环节还没有受到影响。

历史总是惊人地相似。

20年前,JPEG压缩技术让图片文件缩小了10倍,但存储需求反而爆炸式增长——因为大家开始疯狂拍照了。

10年前,视频压缩技术让一部电影从几GB降到几百MB,但存储需求反而继续飙升——因为大家开始刷短视频了。

因此,TurboQuant可能不是存储芯片的终结者,而是AI迅速普及的催化剂。

五、对我们普通人意味着什么?

聊完行业,说说对我们普通人的影响。

第一,AI可能会变得更便宜。

现在用一次GPT-4,背后可能是几美分的成本,对于高频使用者来说,成本还是太高了。如果TurboQuant能让推理成本降低6倍,那AI服务的价格也会跟着大幅下降。说不定以后用AI就是白菜价了。

第二,手机AI可能会更强大。

现在的手机AI大多依赖云端,因为本地内存不够用。若是应用TurboQuant技术将压缩后的模型塞进手机,那就意味着未来的Siri、小爱同学可能真的会变聪明。

第三,创业门槛会降低。

做AI应用最大的成本就是算力。如果推理成本大幅降低,更多小公司也能玩转AI,行业创新会加速。

TurboQuant的故事,其实是科技行业的缩影。

存储芯片行业享受了两年AI红利,现在谷歌一篇论文就让他们市值蒸发几千亿。这不是谷歌有多狠,而是技术迭代的必然。

但换个角度想,TurboQuant本身也是因为有了AI推理成本高企不下的需求。没有Transformer架构,没有大语言模型,没有GPU算力,这个节约算力的算法也无从谈起。

科技行业就是这样,一环扣一环,颠覆与被颠覆往复不断循环。

作为普通人,我们或许无法预测下一个技术突破是什么,但我们可以保持敏感,保持学习。

因为在这个时代,唯一不变的就是变化本身。