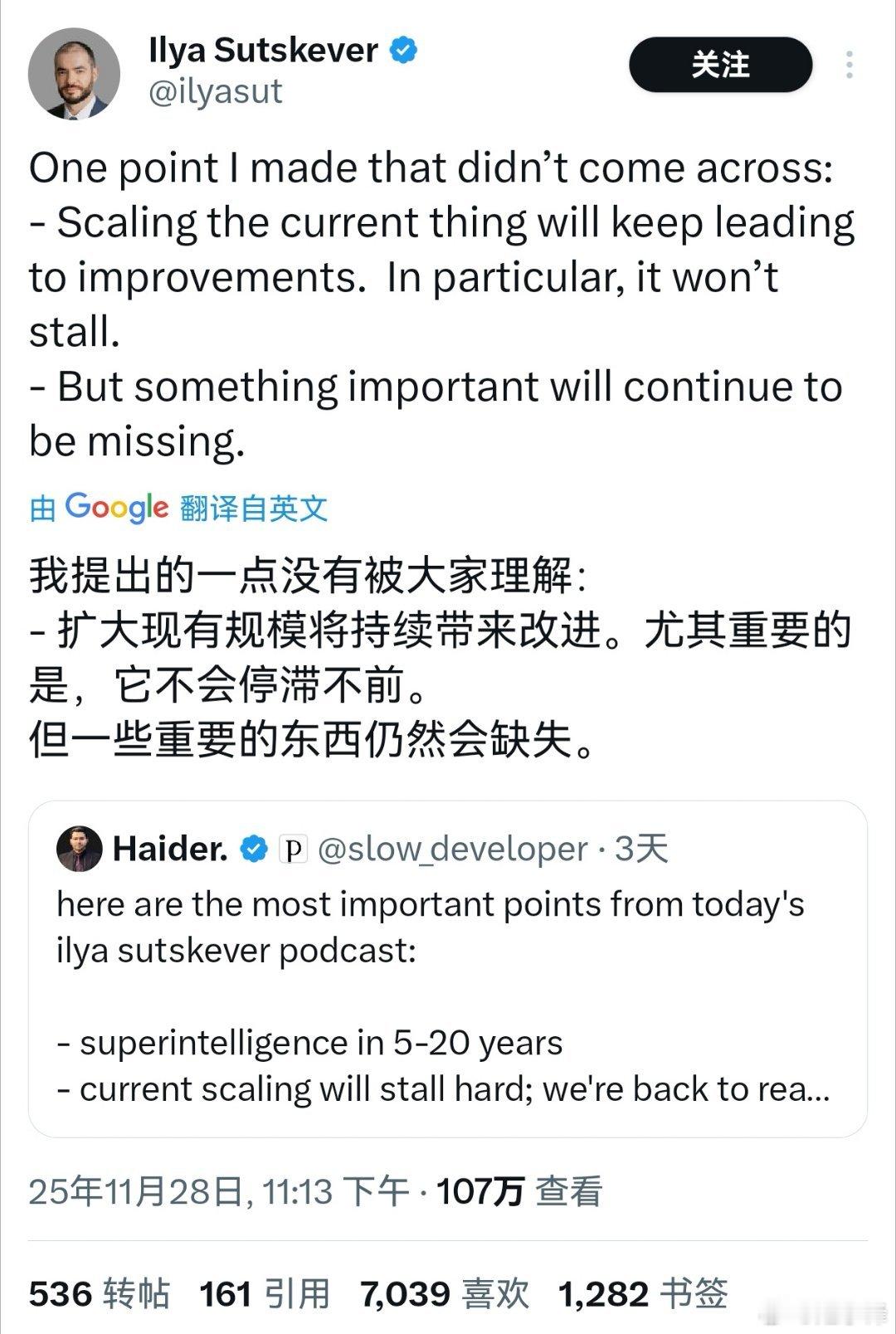

Ilya 针对访谈内容发推做了澄清和补充:> 访谈里有个点我没说清楚,补充一下:> 继续按现在的方法scale——堆算力、堆数据、堆训练环境——肯定还会带来改进。不会停滞,会继续变好。> 但是,总会缺点什么重要的东西。这则澄清意在纠正一个潜在误解。访谈中他多次提及「回归研究本质」「当前方法终将触顶」等观点,容易让人误以为他在否定scaling law,认为单纯堆算力、数据和RL训练终将失效。他明确表示并非如此:现有路径仍将持续推动模型进化——benchmark会稳步提升,产品会迭代更新,商业价值也会持续释放。这种进步是真实存在的。但关键在于"但是"之后的内容:有些本质性能力,无论怎样scale都永远无法触及。这就像短跑训练:通过持续训练,成绩可以从12秒提升到11秒5,再到11秒甚至10秒9,这是可量化的进步。但若目标是学会飞行,再快的奔跑速度也无济于事——这需要完全不同的能力体系。结合访谈语境,这种"重要缺失"具体指向两点:1. **真正的泛化能力**并非依赖海量数据训练后执行多任务的能力,而是从极少量经验中快速学习新知识,并在全新场景中稳定迁移应用的能力。2. **高效学习机制**人类仅需10小时就能掌握驾驶基础,几个月便可胜任编程工作。这种学习效率远非当前预训练范式所能企及。访谈中"两个学生"的类比极具启发性:刷题一万小时的学生确实能从班级前10%进步到年级冠军,这种进步毋庸置疑。但他永远无法具备那个仅用100小时就展现出"悟性"的学生所拥有的认知跃迁能力。