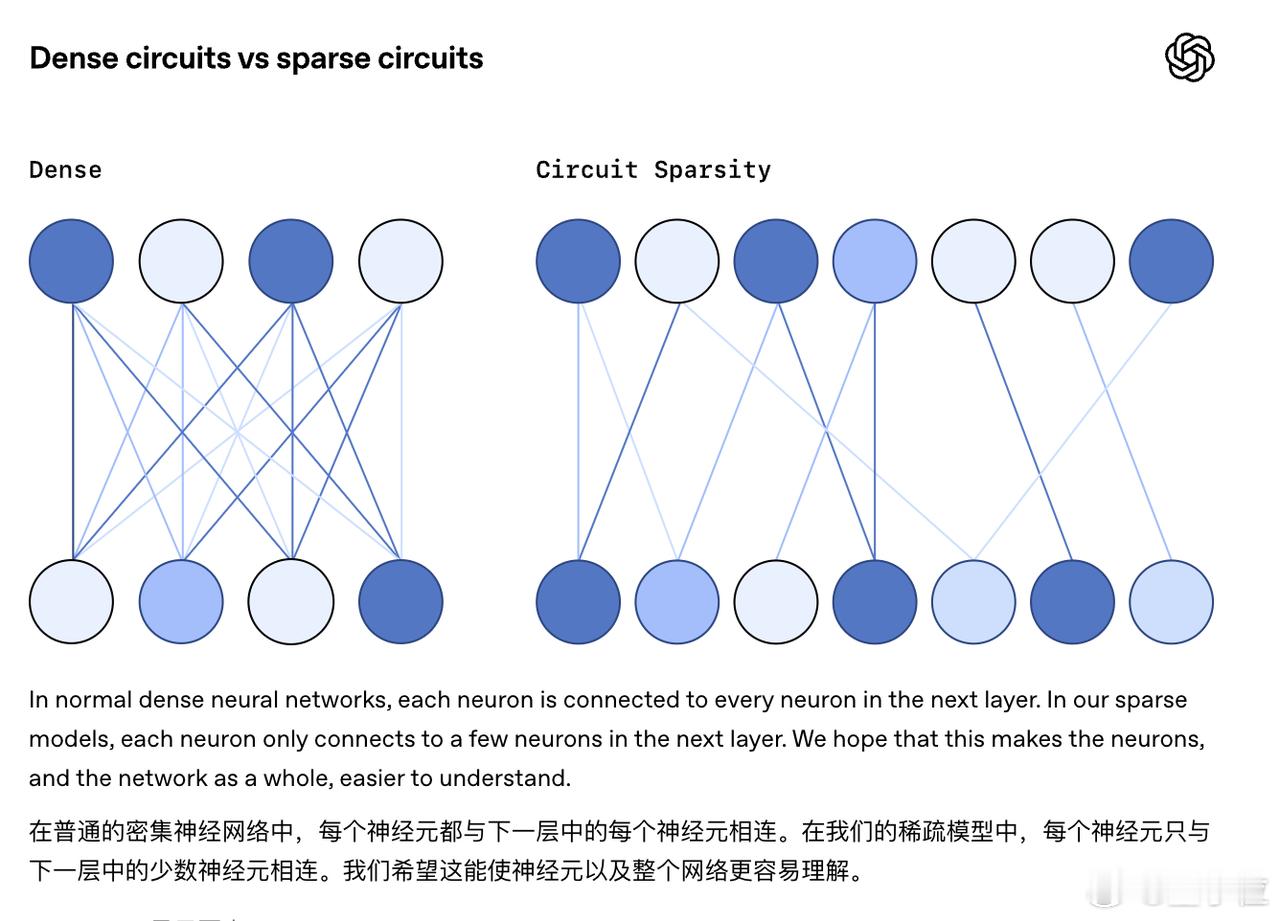

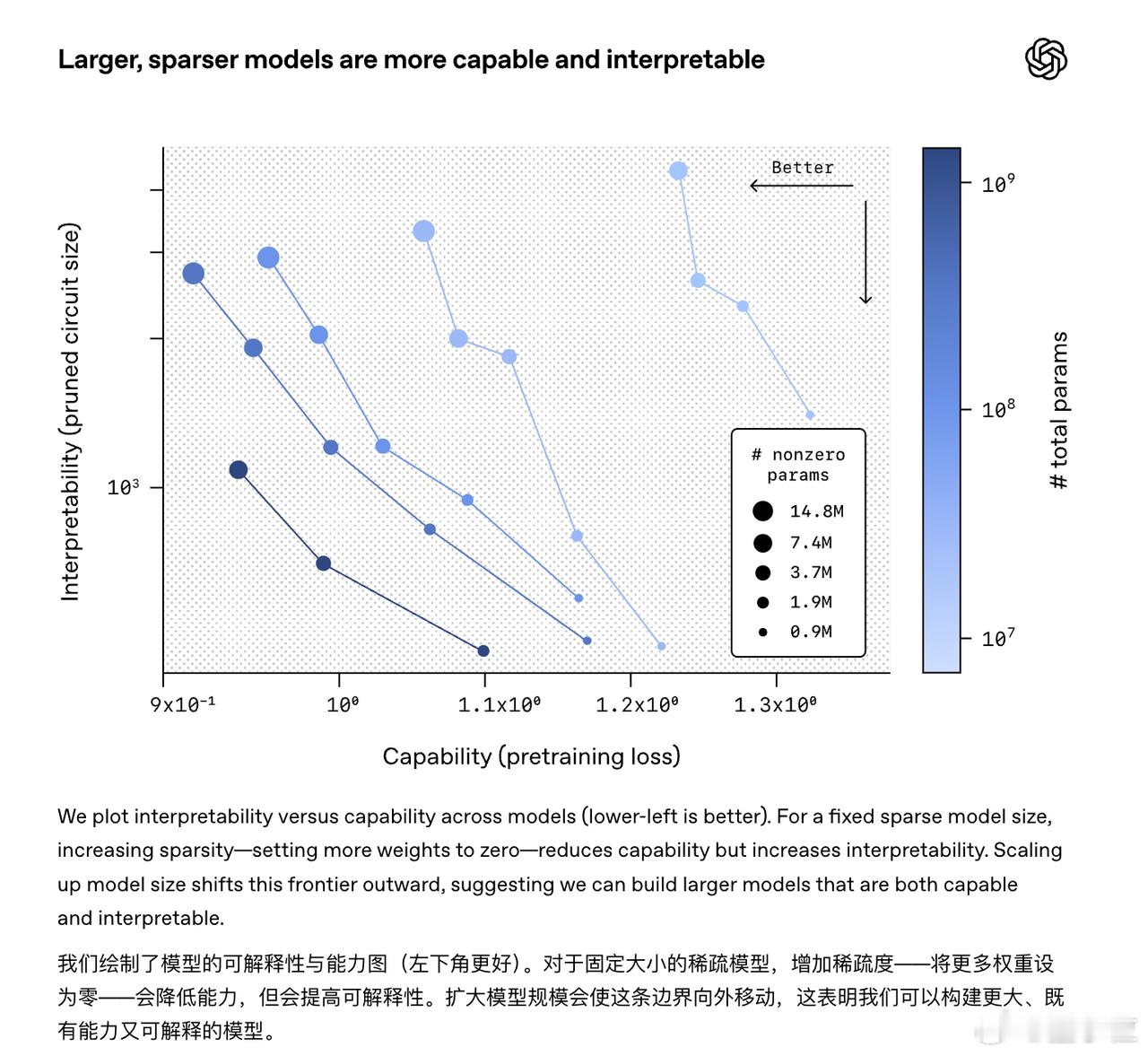

OpenAI新文章《通过稀疏电路理解神经网络》,终于对神经网络“黑箱”,给出了合理的解释。一直以来,大模型都是人类自己创造的"黑箱"。我们设计训练规则,但涌现出来的具体行为却无法解释,数十亿个神经元连接缠绕在一起,没人能说清楚AI大脑里发生了什么。OpenAI最新研究,终于给这个谜团开了一扇窗。传统密集神经网络有个致命的设计缺陷叫"叠加"。为了节省空间,模型把各种不同的概念强行塞进同一个计算通道里,就像一根电缆混杂了电力线、电话线和网线。这导致任何一个神经元都在同时处理多个截然不同的任务,结果就是彻底的"信号干扰"。你无法指着某个神经元说,这家伙负责检测引号,那个负责追踪变量类型。一切都混在一起,无法解读。而OpenAI的新想法简单得惊人:既然密集导致混乱,那就从源头强制制造稀疏。他们在训练Transformer时设定了一条铁律,让模型中绝大多数的权重必须是零。这就像要求AI的电路板只能使用最少的焊接点。被这个约束强制后,模型无法再偷懒混杂概念。它必须把"这是一个开引号"这样的信息,清晰独立地储存在专属的神经元通道里。由于连接点极少,模型也只能学习最直接的算法来完成任务。接下来才是真正的"解谜"环节。研究人员准备了一系列简单任务,比如判断Python字符串该用单引号还是双引号。然后用特殊的剪枝技术,隔离出执行任务所必需的最小计算路径。结果令人震撼:相比传统密集模型,这种稀疏模型的最小电路竟然小了16倍。这些被分离出的微型电路展现了前所未有的人类可读性。论文甚至展示了一个完整的字符串闭合电路,仅用12个节点和9条边就完美完成了任务。你可以像读编程流程图一样读懂它。第一步检测到开引号,标记引号类型,然后查找之前出现过的相同引号,最后复制这个信息到字符串结尾来预测闭合符号。这是实实在在的算法逻辑!它从根本上改变了我们理解AI的哲学。长期以来,可解释性被认为是最难的挑战。这项工作证明了,与其试图去理解一团乱麻,不如设计出天生清晰的AI。至少在基础能力层面,AI的思考过程可以像人类编写的算法一样被彻底理解。其次,这对AI安全至关重要。当模型越来越强大,如果它学会了欺骗、隐藏信息甚至做出有害行为,我们却完全不知道内部逻辑会怎样?有了这项技术,研究人员可以像排查电路故障一样,精确定位和隔离危险回路。这是构建可控、可信AI的关键一步。当然现在还有局限。稀疏训练效率很低,目前还训练不出GPT-4这样的顶尖能力模型。但研究提出了一个重磅潜力方向,他们开发了技术可以把稀疏模型学到的清晰概念回路,映射到现有那些庞大复杂的密集大模型上。这意味着未来我们可能不需要重新训练全新的AI,就能用稀疏大脑的翻译器去理解现在正在使用的那些强大模型。总结来说,OpenAI这项工作证明了:即使是复杂的智能,其底层机制也可能是简洁、可读、可被人类驾驭的最小代码。我们正在从被动观察AI行为,转变为主动阅读AI的思考逻辑。这条从黑箱走向白盒的路刚刚开始,但方向已经确定。