兄弟姐妹们,又到了不定期的“科技剧本杀”时间。让我们感谢Meta送上的新本子,sEMG。

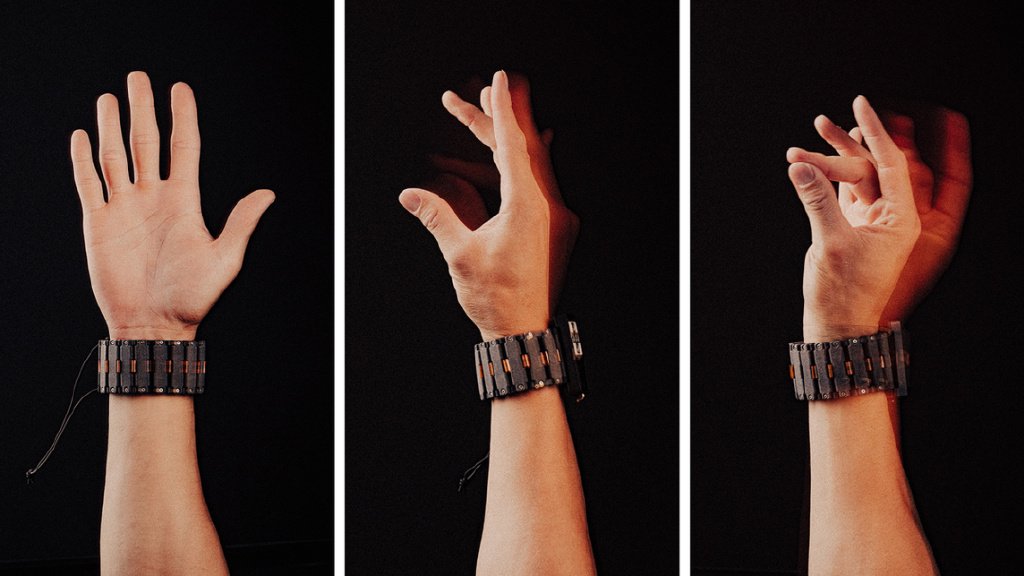

这阵子,Meta下一代设备“MetaCeleste”的相关报道非常多,主要还是因为它是个套装,里面包含一个(民用消费级)罕见的设备:肌电手环。而且Meta计划在今年秋季发布Celeste套装。

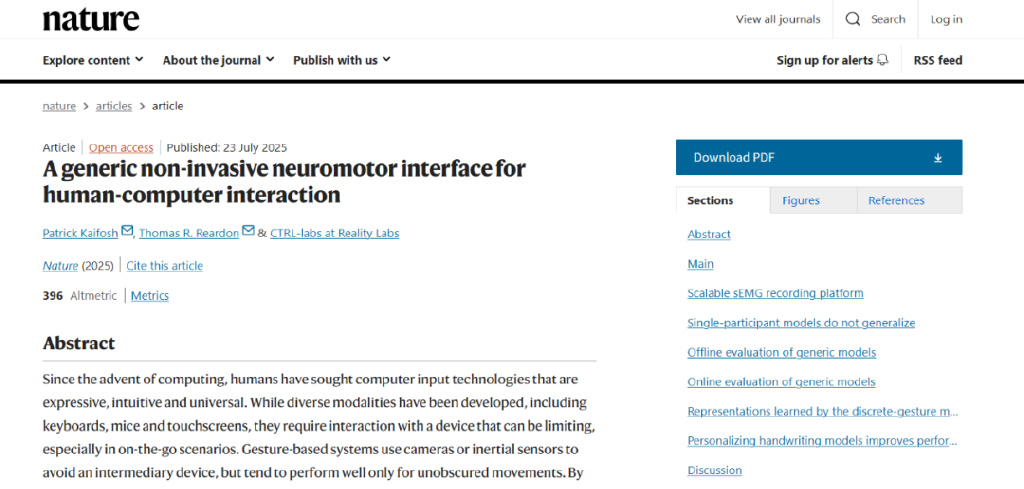

这效率,这风格,实在不像硅谷用PPT找钱再做产品的风格。赶巧了,Meta把关于sEMG的论文在《Nature》上发布了,我们一起看看怎么个事儿。

本文从方便易懂的角度快速帮普通人理解和接受一些好玩有趣的技术,如果有事实性错误,欢迎在评论区指出,文末会放上Nature原文PDF下载。感谢大家!

关于什么是sEMG

这篇文章的名字叫《Agenericnon-invasiveneuromotorinterfaceforhuman-computerinteraction》,直译为“用于人机交互的通用非侵入性神经运动接口”,再简单一点就是,用来操作电子设备的、不用手术开刀的、神经运动设备。

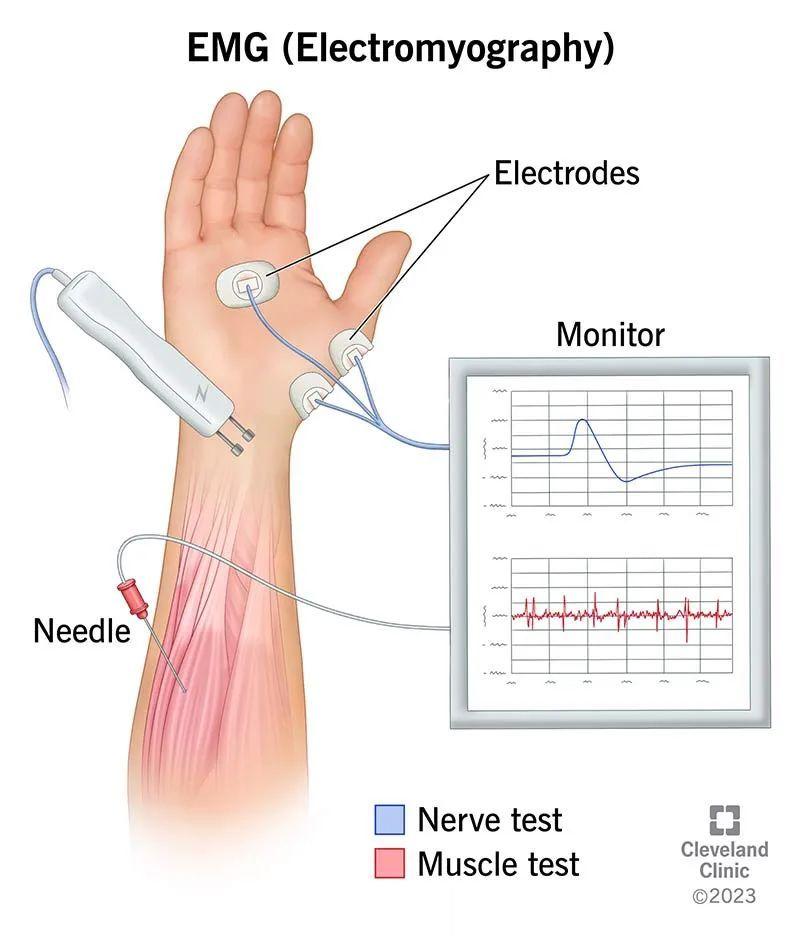

EMG,全称Electromyography,由三个词根词缀构成,分别是electro电,myo肌肉,graphy图像化技术。一个有趣的题外话是,原本electro是琥珀的意思,据说古希腊人发现琥珀摩擦能带电,后面这一词就被引入为代指与电相关的事物。

言归正传,EMG根据词的构成就可以明确知道它是肌肉电信号图像化技术,也就是肌电图。

当你想动动手指比个国际友好手势的时候,大脑会通过神经系统向肌肉发送指令,这时,身体会发出微小但可测量的电信号。获取并解读这些信号,可以帮助我们通过机器来更直接、省力的指挥机器。

这个事儿其实还有很多扩展理解,用来证明EMG或者BCI等等直接与人脑、人体挂钩的技术所衍生出来的交互的必要性。

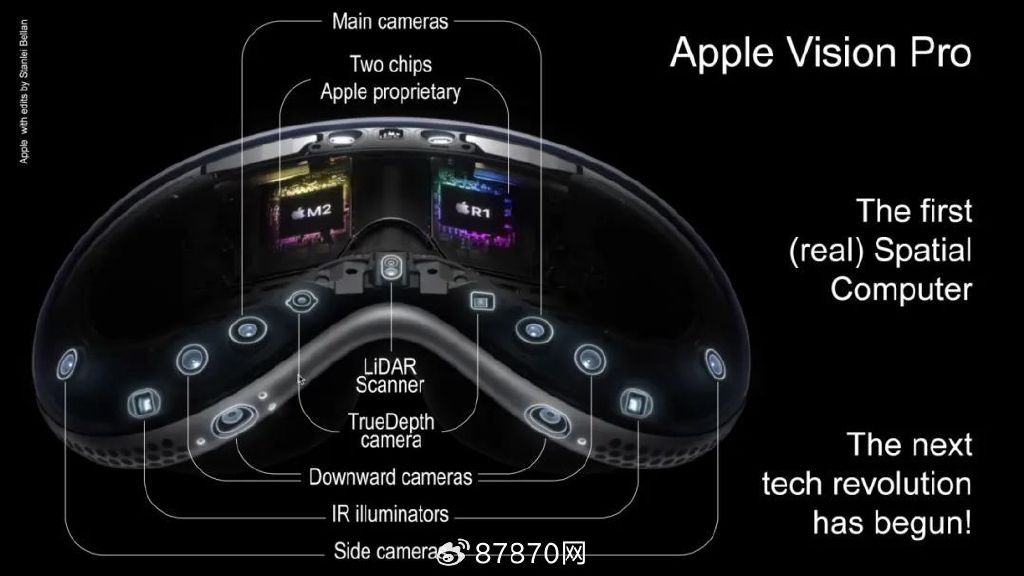

比如苹果VisionPro,非常牛,通过十多个摄像头来实现眼动、手势的追踪,现在苹果已经能做到非常高精度,传输速度和解码速度也很快。

但它有一个严重且致命的问题,在Meta的文章中也有提到:

“ThenatureofthesEMGsignallendsitselfnaturallytohuman-computerinterface(HCI)applicationsbecauseitisnotsubjecttoproblemsthatvexcomputer-vision-basedapproaches,suchasocclusion,insufficientlightingorgestureswithminimalmove-ment.(sEMG信号的性质使其非常适合人机界面(HCI)应用,因为它不会受到基于计算机视觉的方法所面临的问题的影响,例如遮挡、光照不足或运动幅度较小的手势。)”

就是说这类的计算机视觉,它需要有一定的光照条件、不能被遮挡,还只能检测运动幅度相对较大的动作。

人类一直在追求更极致的人机交互方式,从键盘改排列到多点触控、语音输入、面部识别等等技术的广泛应用也印证着这一点。当然了,它们是并存的,并不会是完全的替代关系。

所以现阶段与计算机视觉共同发展的还有一个——脑机接口BCI,与之同一个派系、广义上来讲算是BCI的就是我们今天的主角,肌电信号EMG。

我们上面提到,EMG是获取身体的电信号。怎么获取呢?

通常有两种方式,侵入式和非侵入式。(这个跟BCI也一样)。

侵入式EMG会直接把细小的电极插入肌肉里,精度高、信号清晰,通常只用于医疗或科研场景,比如诊断神经疾病。

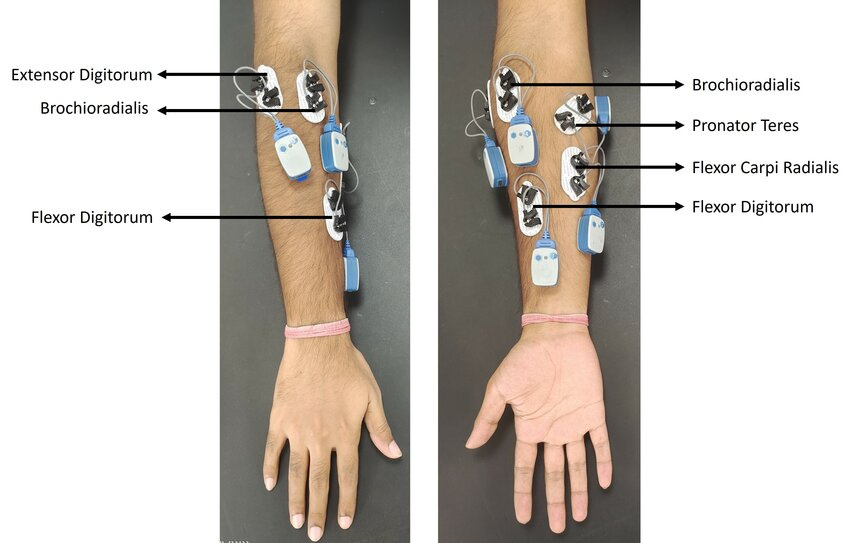

而非侵入式,就是Meta正在研究的,也叫sEMG,surfaceElectromyography表面肌电图。顾名思义,就是通过贴在皮肤表面的电极,来感知皮下肌肉的“发电”。

它对人体没有伤害,至少不用扎小针针,通过算法的进步可以实现无感实时监测,几乎可以做到“心动身动”。而且,非常适合穿戴设备。

事实上,非侵入式的sEMG在假肢领域已经取得相当的成功,很多残障人士已经在使用它们了:

那问题又来了,这不是用上了吗,Meta怎么还做?当然因为这里面还有很多隐藏问题,比如残障人士毕竟是有针对性的使用,跨人群了还能这么好用吗?手上姿势千变万化,怎么区分举手和投降?这个玩意距离量产上的可能性、稳定性、标准化还有多远?这都需要进一步研究和验证。

Meta的sEMG工作原理

所以,其实目前对于sEMG技术用在消费级产品上的难点已经非常清楚了,通用(包括姿势和人群)、可靠性和准确性。

那么Meta是怎么解决的呢?(这真是一个漫长的过程)

先看通用性的问题。根据Meta的研究,同一个人同一个姿势,昨天和今天也有很大的差别。

“Wefoundthatthecosinedistancesbetweenwaveformsofthesamegestureacrosssessionsandusersheavilyoverlappedwiththedistributionofdistancesbetweenwaveformsofdifferentgestures.(我们发现,不同会话和用户之间相同手势的波形之间的余弦距离与不同手势的波形之间的距离分布高度重叠。)”

也就是说,即使是同一个手势,不同用户或不同时间做出来的肌电波形,其相似度也和“完全不同的手势”差不多——这说明用技术模板(通用模型)来识别手势非常难,因为“同一个手势”的信号在不同人之间并不稳定。

肌电数据太个性化了,想要实现通用就得用大量的数据把“个体间的变化”喂给模型,或者加入位置矫正等来提升稳定表现。

为解决这个问题,Meta构建了一个数据集,涵盖数千名参与者(不同任务范围从162人到6627人不等)。

主要完成三个任务:一维手腕连续控制、离散手势识别、空中手写识别。也就是模拟光标移动、点击长按等、无实物手写。

期间,Meta利用设备实时记录肌电信号,使用48通道电极阵列、2kHz高频采样,并结合摄像头进行运动标注校准,还开发了用于“动作-信号”对齐的算法,以确保每一条数据都精准标注。

最后针对不同的动作,Meta采用了不同的神经网络模型,比如离散手势识别用1D卷积网络+LSTM。

换个思维方式,方便理解。就好比瑞幸卖咖啡,发现只卖美式、拿铁、卡布奇诺对于没有喝咖啡习惯的大部分中国人来说,不太适配,便宜当然可以卖,但做不到最大化。

虽然你知道咖啡怎么做,模板是咖啡液体萃取+水/奶,但你没办法用这个模板卖给14亿中国人。

怎么办?根据季节的变化、市场习惯不停地尝试新的单品和口味。比如招牌生椰拿铁,全国范围内的爆品。

但这还不够,为了更进一步扩大范围,还要针对不同的季节,推出各种水果+咖啡的组合,也就是Meta对于离散手势识别采用的1D卷积网络+LSTM。

效果怎么样呢?

图a的实验是需要用户把光标移动到目标位置,结果比如图d,表明sEMG的目标命中时间1.01s要高于动作捕捉的1.99s。图f表示首次命中概率sEMG腕带可达0.96,已经非常接近理想值。

图b的实验,需要用户用不同的9种手势,比如捏和、点击等解决圆圈,图g代表手势完成速度,0.88次,接近使用NS手柄,要远高于初期,是比较容易上手的意思。

图h主对角线准确率均达89%~95%,说明误识别率很低,模型对手势识别的区分度很高。

图e的实验要求用户根据屏幕提示,在空中写出一句话。图j表明,平均输入速度稳定在18-20.9(字/分钟)。这个数值目前已经非常接近自然写字的25.1(字/分钟)。

这套方法和实验的结果也表明了,Meta的sEMG在表现上已经非常接近传统交互设备,微手势的识别率也达到了90%以上。虽然还没有超越传统输入方式的上限,但已经达到“可持续使用”级别,足以在AR/VR、辅助交互等场景中实用落地。

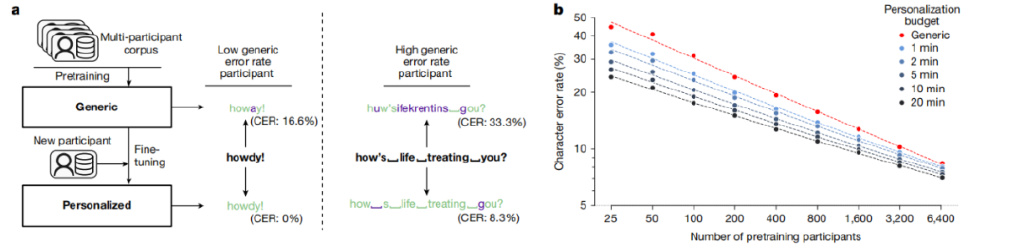

考虑到非常特殊的个体差异,Meta也加入了微调,使用仅20分钟用户自身数据对通用模型进行微调,可将手写识别错误率平均下降16%,而且,他们发现对于泛化表现较差的用户,个性化收益反而更高。

就是如果你想要拿筷子,但你平时用的是食指和无名指夹住筷子,也没事,调一下就能用。这也为那些“通用模型识别不了”的人群,留了一个兜底方案。

顺便一提,Meta论文中明确提到,肌电手环的核心神经解码模块功耗仅为6毫瓦,已经可以支撑多天续航。

突发奇想?NO!

这篇论文的收稿时间是2024年2月,录用日期是2025年6月,7月23日出现在《Nature》网站。

但实际Meta早就开始了对于肌电手环的研究。最早可以追溯到2019年。

2019年,Meta收购CTRL-Labs,随后由联合创始人、神经科学家ThomasReardon继续领导这一项目。截止到目前,已经至少持续了6年时间,所以在今年秋季上市,87君还是觉得比较靠谱的。