大家好,我是波导终结者。

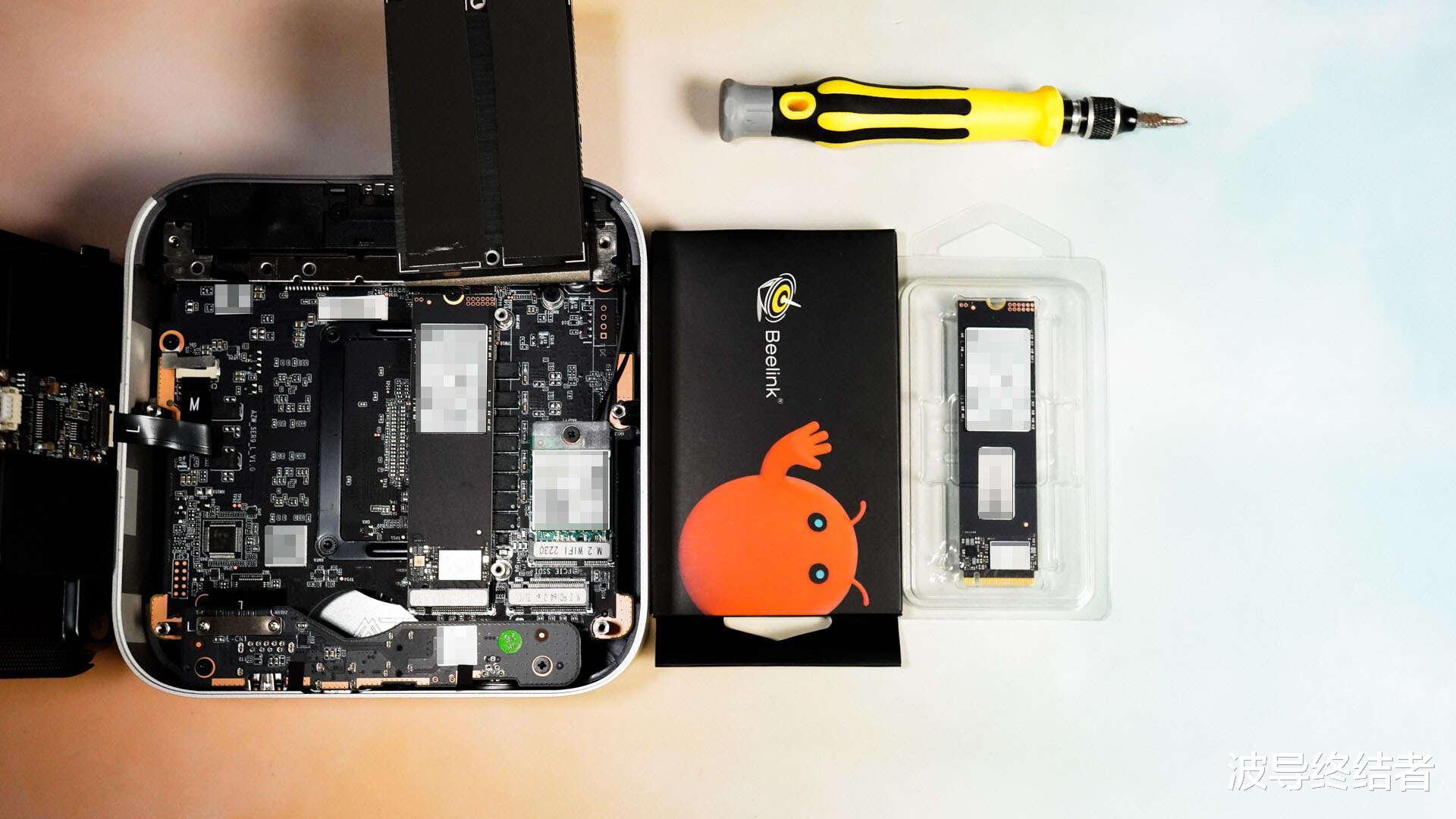

目前零刻共有H 255,HX370,HX470三款预装机子,其中后两款提供OpenClaw+本地大模型升级,而H 255是本地OpenClaw加云端模型连接。我想了一下,虽然HX370的890M核显确实比H 255的780M强一些,但H 255应该多少也能跑一些。这次我要自己加上本地大模型的部署。加装硬盘的步骤就不赘述了,之前分享过拆机的,直接两块硬盘一起上。

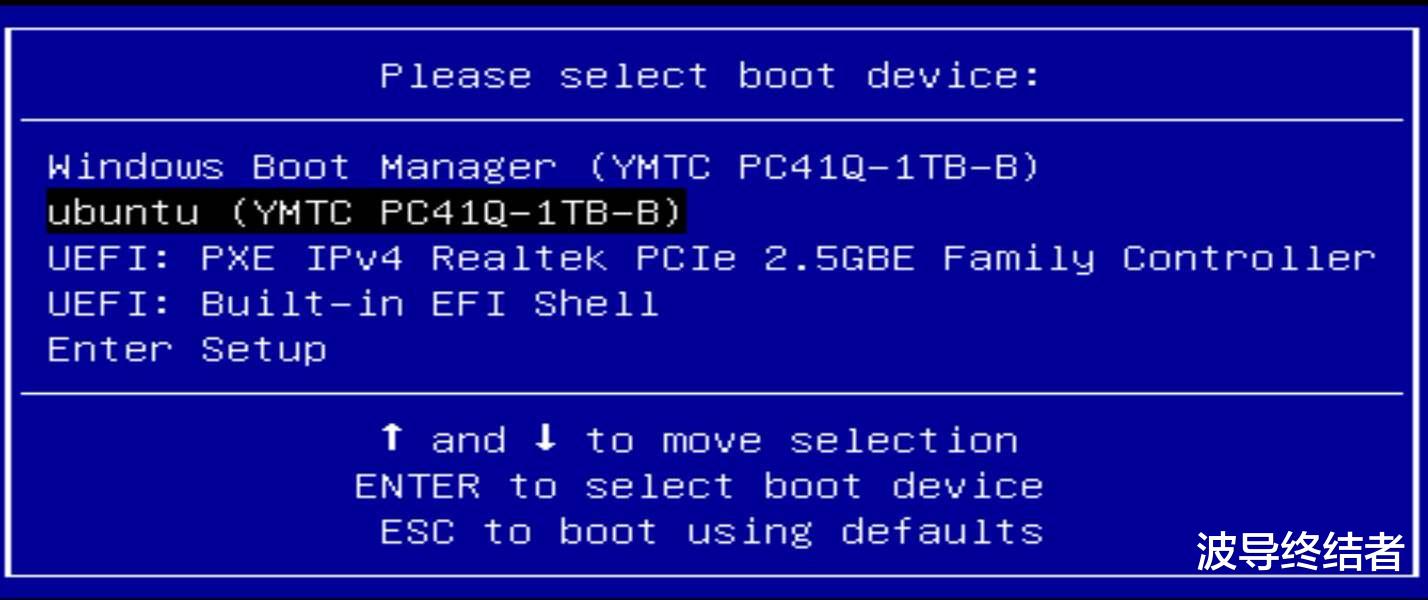

事先说明一下,零刻部署的这个OpenClaw是运行在ubuntu上的,不知道后面会不会有部署在Windows上面的选项。像我这样双固态硬盘,开机的时候按F7,选择ubuntu就行,还想回去办公的话进默认的Windows Boot Manager,互相不影响。

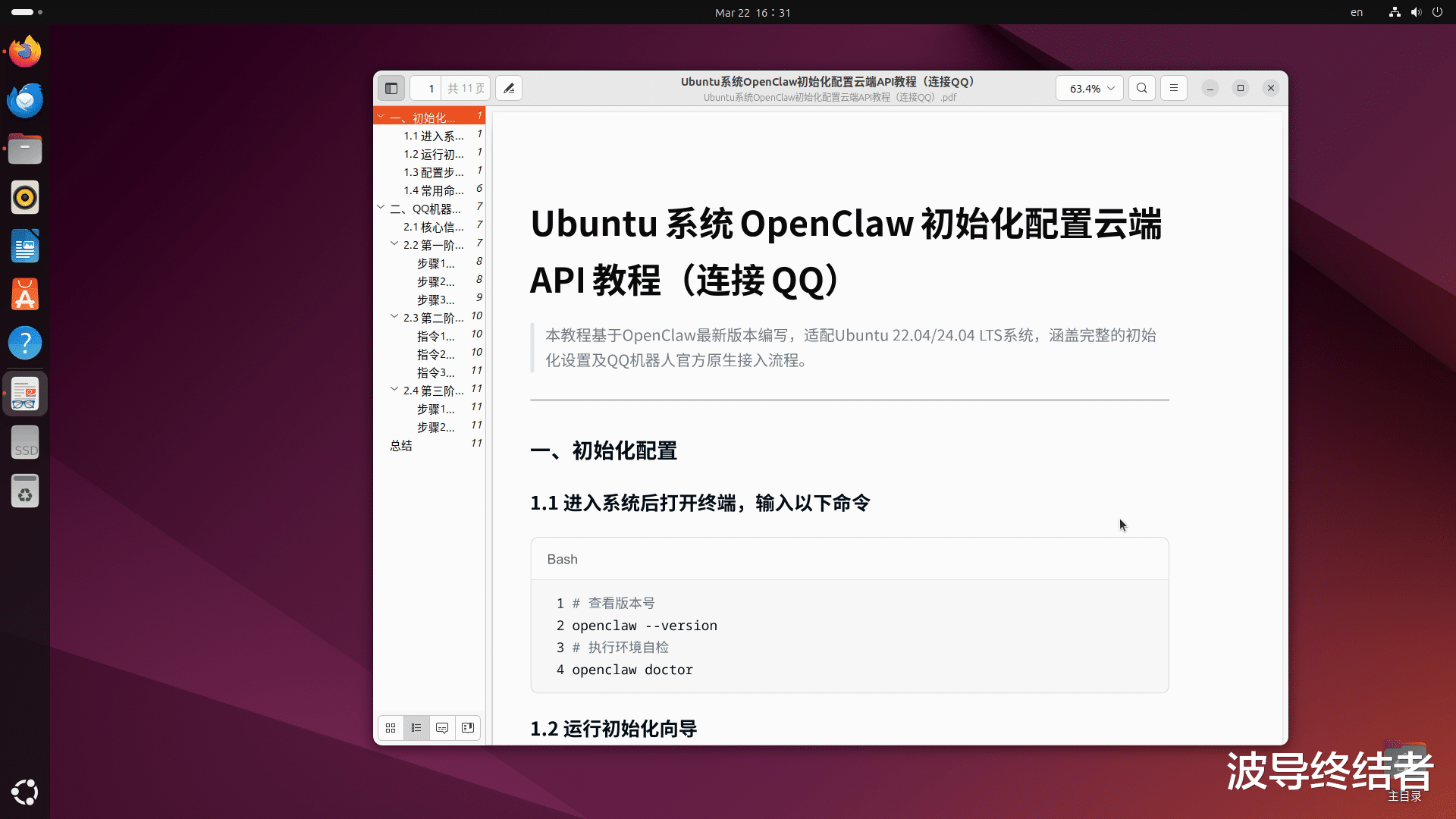

ubuntu开机初始化的过程就不贴出来了,与本次主题无关。在home文件夹下会看到说明文档,从OpenClaw初始化,到配置云端API,再到连接QQ机器人都非常详细。我觉得如果照着做还弄不懂的,可能也不适合玩龙虾了。倒是我要在其之上,加配本地部署,就还是得折腾一番。

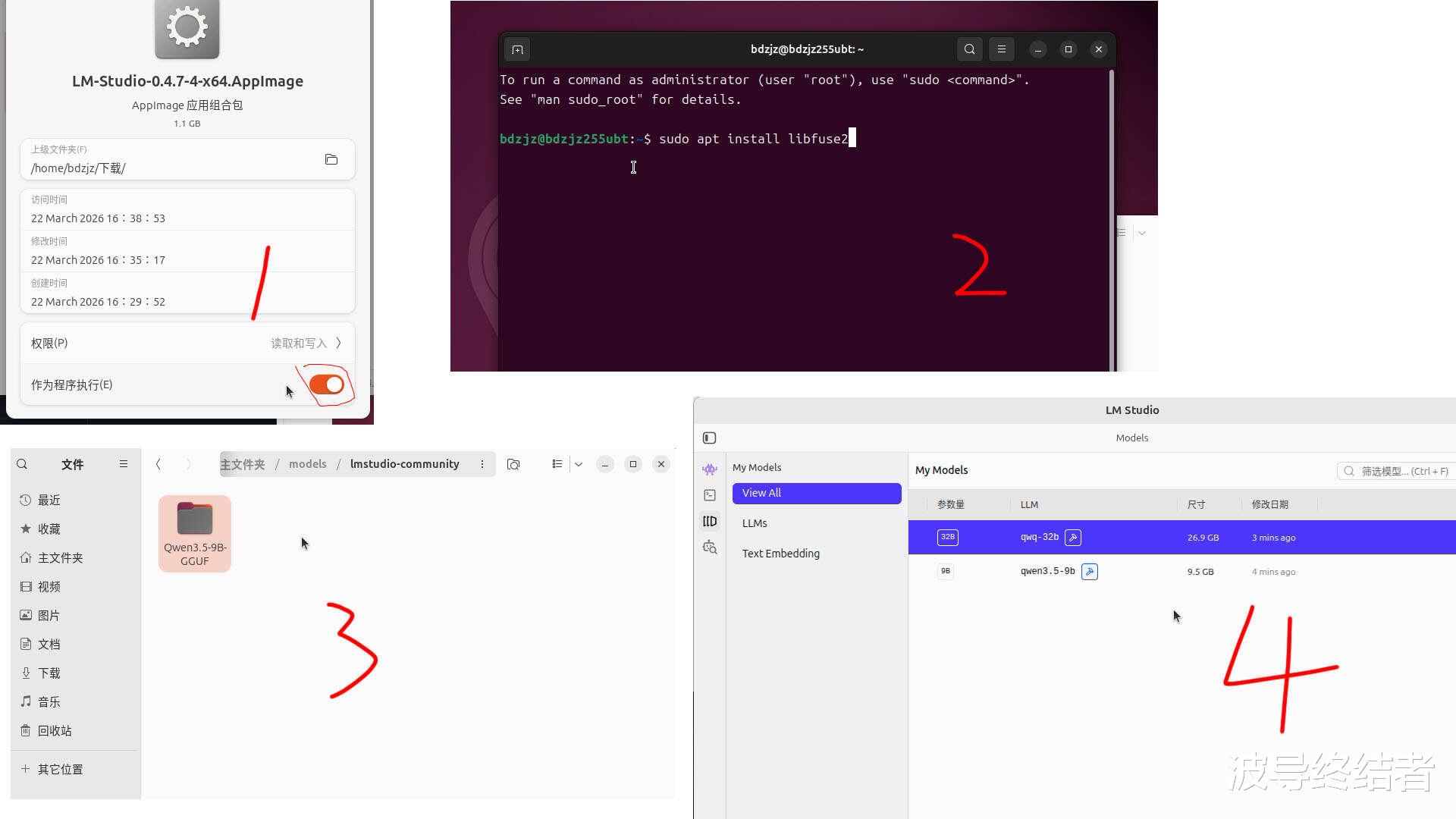

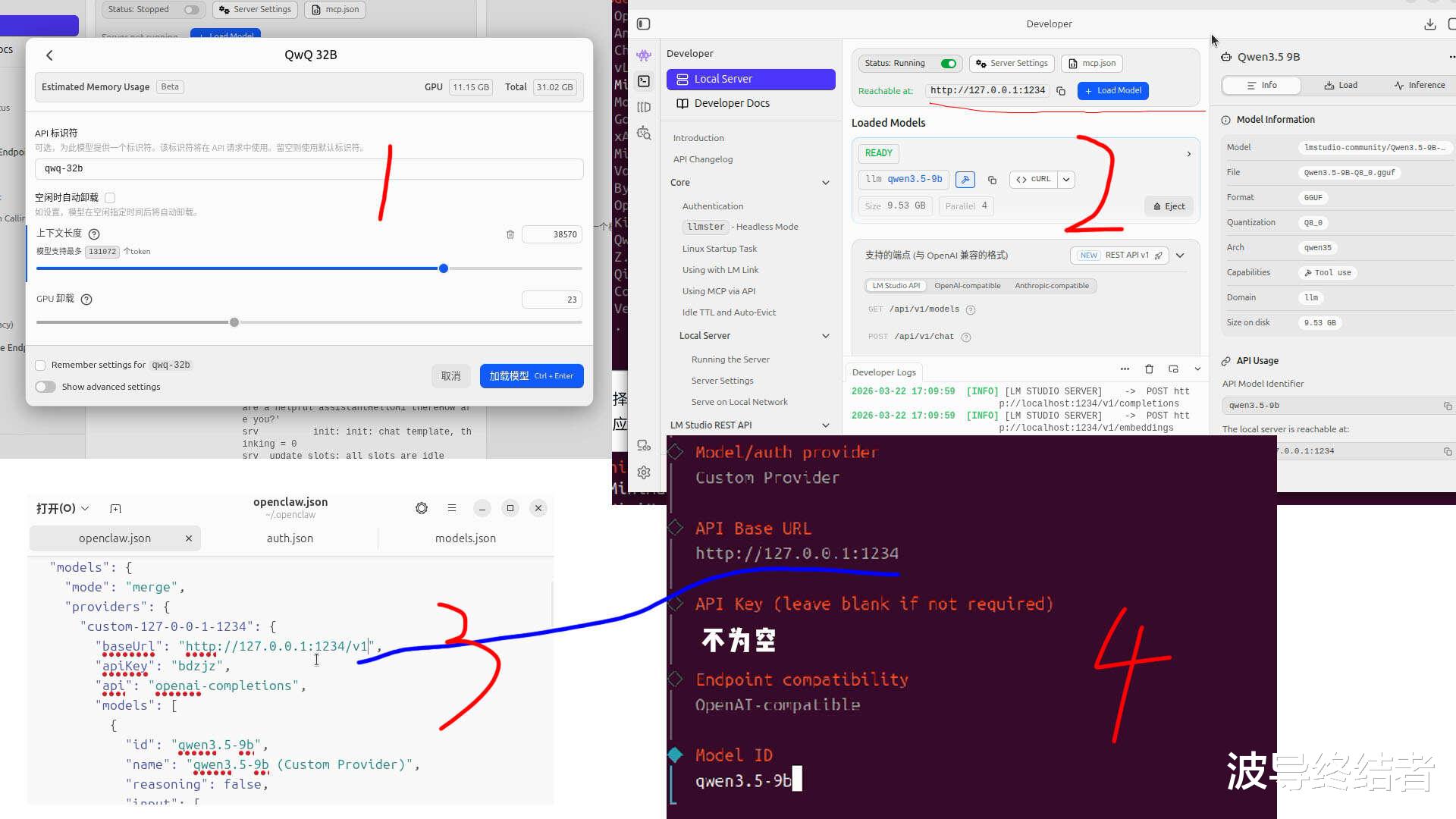

这其中的各种坑,我帮大家先整理出来,仅供参考。首先,我是用LM studio

部署的,如果你用ollama或其它,请参考相应的教程。ubuntu/Linux下载得到的是一个Appimage文件,直接运行需要在属性里打开“作为程序执行”的权限,如上图1。第二点,最新版本的的ubuntu缺少库支持,还需要执行sudo apt install libfuse2才能够运行Appimage文件,如上图2。第三,ubuntu下的LM studio模型文件夹需要多一层lmstudio-community文件夹,如上图3。一切OK之后,软件能扫到本地模型,就可以准备下一步了。

接下来,LM Studio里载入模型,我试了一下手头的Qwen3.5-9b和旧的32B,这里建议大家用Qwen3.5-9b,零刻官方的本地模型也是用的这个。因为OpenClaw对Token要求非常高,增加Token上限将会极大增加内存占用,就算我的H 255机型是32GB内存,也跑不了32B全开。第二,LM Studio打开调试模式,打开局域网调用,见上图2。第三,API Base URL后头有个杠v1,见上图34区别。第四,本地不需要API Key但不能为空,随便填。

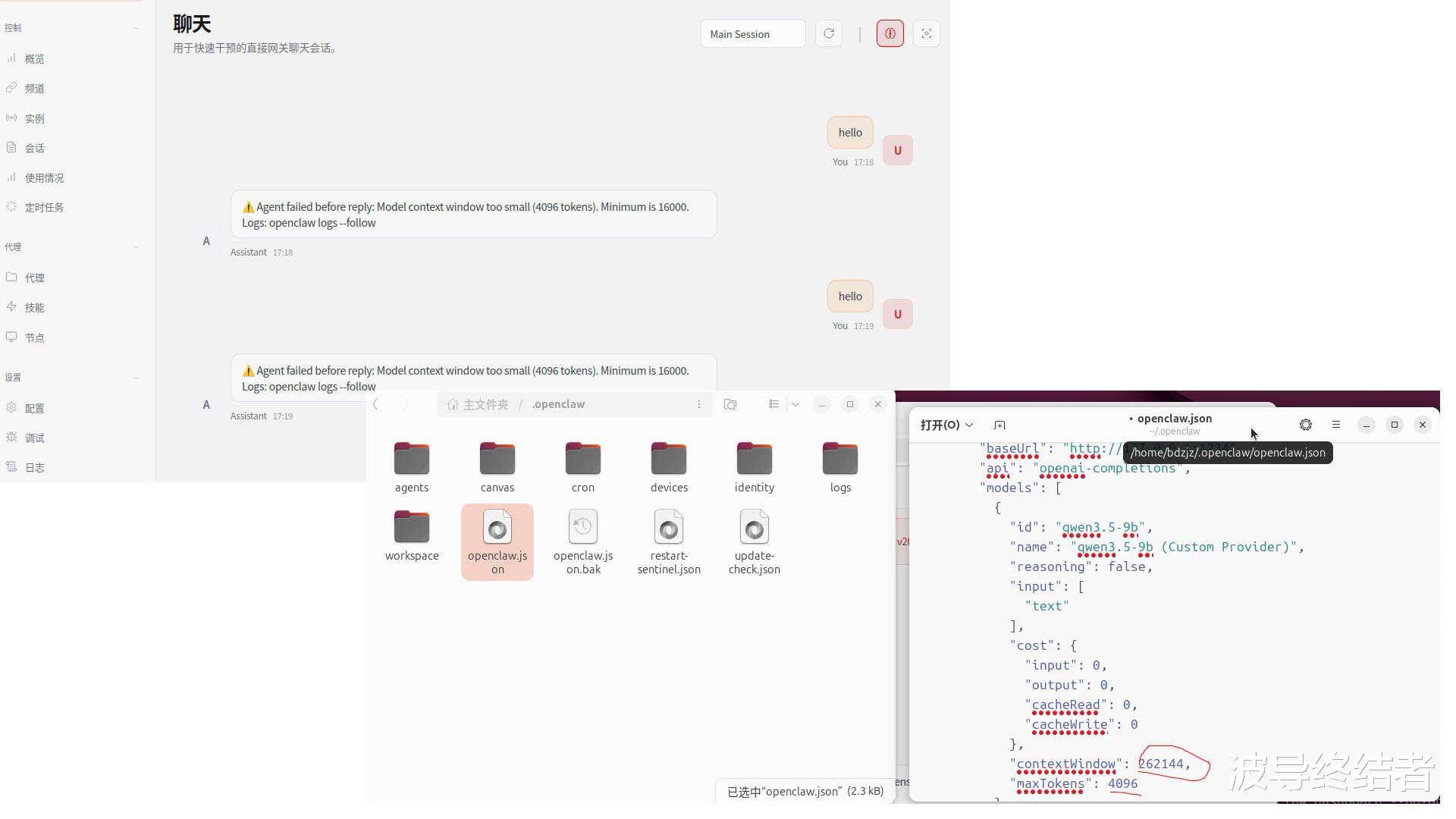

另外,由于我们本地部署模型,算是自定义,有一些参数没有成功同步,还得手动修改,核心就是Token数量。想要跑起来,龙虾提示Token上限至少要为16000,但默认只有4096,我们虽然在LM Studio里改了上限,但没有同步到OpenClaw中,如上图左上。我们找到openclaw.json,打开,找到Tokens相关的两个参数,都改为你模型设置的上限(我这里为262144)。

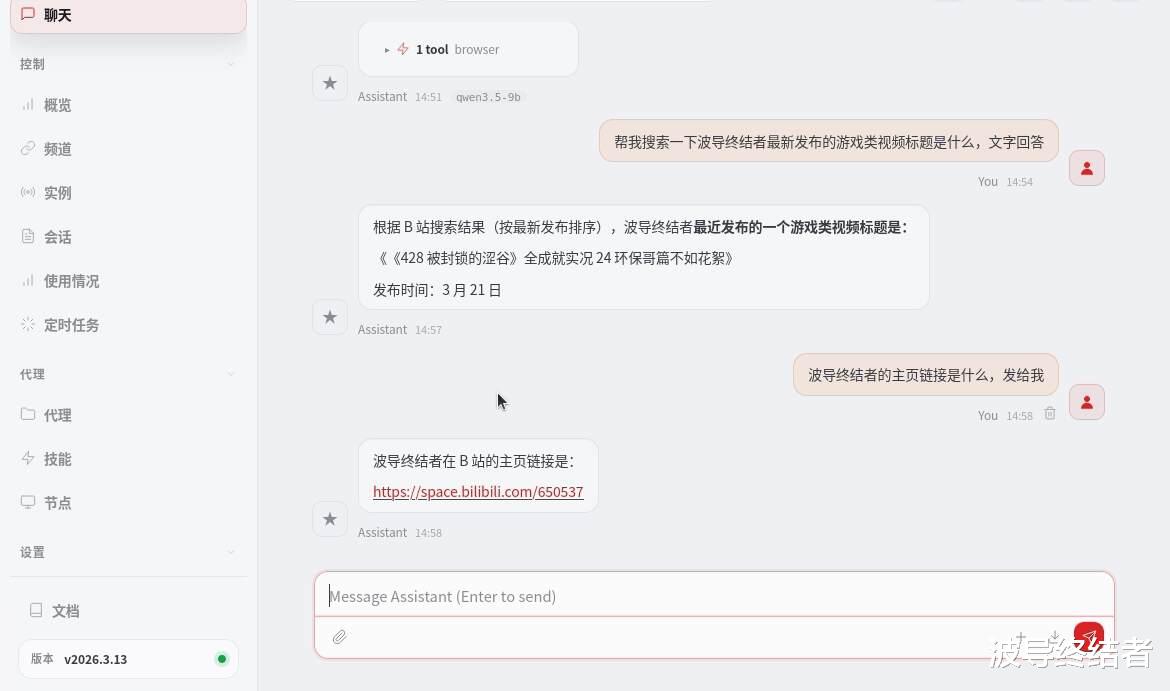

在以上步骤都正确之后,OpenClaw终于有回应了。从这里也可以看出它为什么这么吃Token,我早先问他配置的时候部署有问题,没有出结果,后面Hello两次之后,配置正确了它还给我把结果吐出来了。要维持这些是需要大量上下文Token的,不过听说各家已经在研发不依赖模型Token的本地上下文,让我们多期待期待吧。

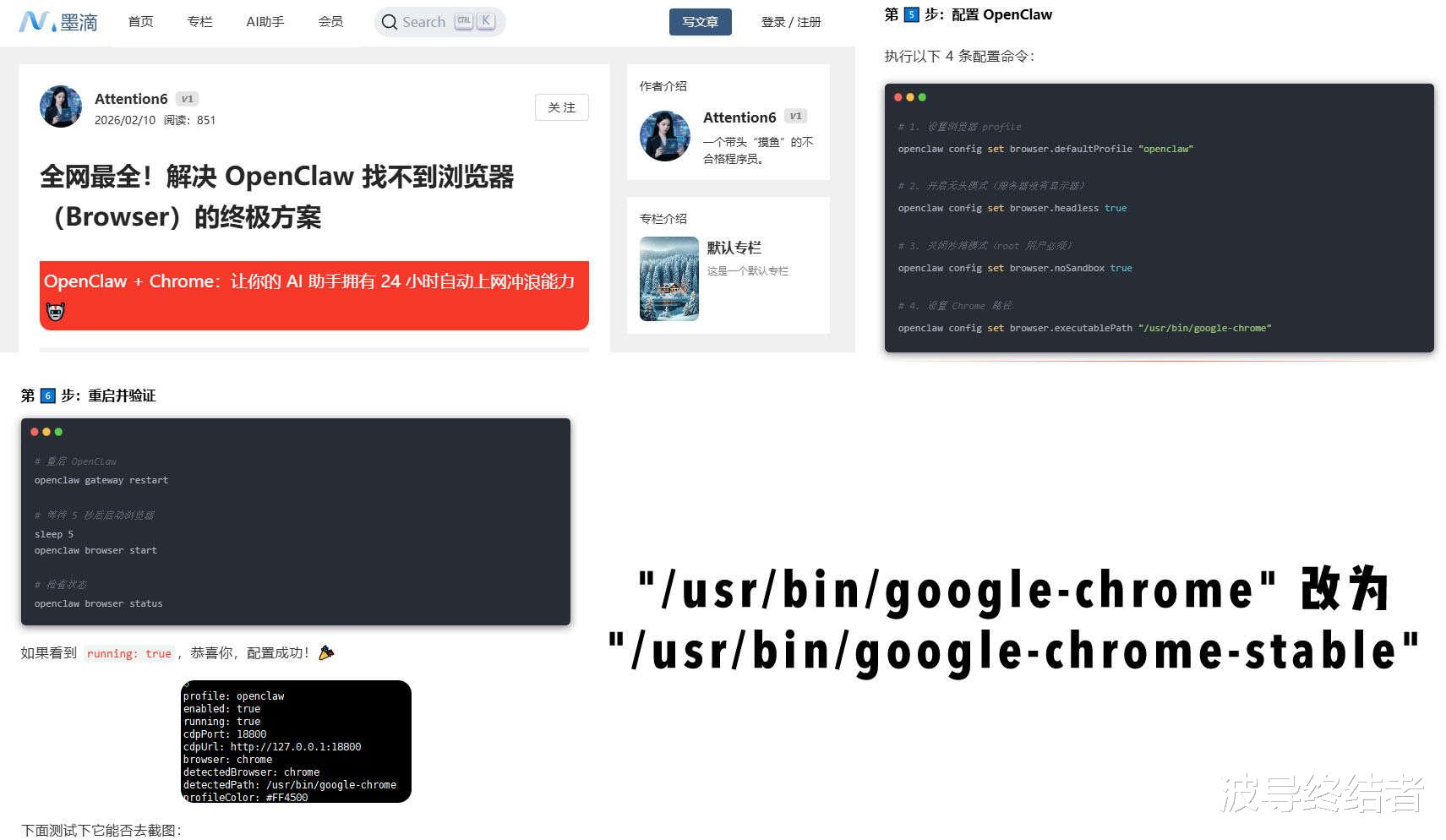

至于接下来,还想让OpenClaw干更多活的话,就看每个人各自的需求了。比如较多人可能需要它帮你查点什么资料之类的,就需要连接浏览器。零刻OpenClaw升级包里只有预装FireFox浏览器,没有Chrome,而OpenClaw目前只能连接Chrome。我参考的是这篇《全网最全!解决 OpenClaw 找不到浏览器(Browser)的终极方案》,再加上自己的一点修改。从下载到安装,里面已经写得很清楚了,但我自己用的时候,必须要把参数里的"/usr/bin/google-chrome" 改为"/usr/bin/google-chrome-stable",才能连接成功。由于ubuntu、OpenClaw、Chrome的版本变动都较为频繁,而且不同环境的情况又不同,仅供参考。

比如我叫它查我自己发布的视频,或者空间主页,就很方便了。当然,对保密要求更高的朋友,完全本地单机运行,或者脱离广域网仅在本地局域网内调用,也是完全可以的。具体的每个人需求都不一样,就看各自的使用场景和发挥了。

最后,本地模型毕竟规模和速度是没办法跟服务器集群比的,需求或者预算更高的朋友,考虑上HX370之类更高配的机型,或者云端模型也是值得的。我这里主要还是觉得H 255的性能不算太差,顺便也想自己试试部署连接本地模型,然后试着跑跑。至于零刻官方教程里的初始化OpenClaw、连接QQ机器人等,都是很基础的跟着下一步就行,这里我就不贴出来重复了。

本篇文章为波导终结者原创,全部图文均为手搓无AI,感谢大家的观看,点赞和关注。欢迎大家评论区交流。我们下期再见。