机器之心发布

近日,开源具身智能原生框架 Dexbotic 宣布正式支持以 RLinf 作为其分布式强化学习后端。对具身智能开发者而言,这不仅是一次普通的工程适配,更意味着 VLA 模型研发中长期存在的「SFT 与 RL 割裂」问题,正在被真正打通。

这是一种典型的「乐高式协作」:双方不强行 Fork、不粗暴揉合代码,而是保持清晰边界,通过标准接口完成模块化拼装。Dexbotic 不隐藏、不替代 RLinf,而是为其能力提供自然的承接入口;RLinf 也不侵入 Dexbotic 的策略生态,而是以稳定可靠的分布式 RL 能力,为模型后训练提供底座。

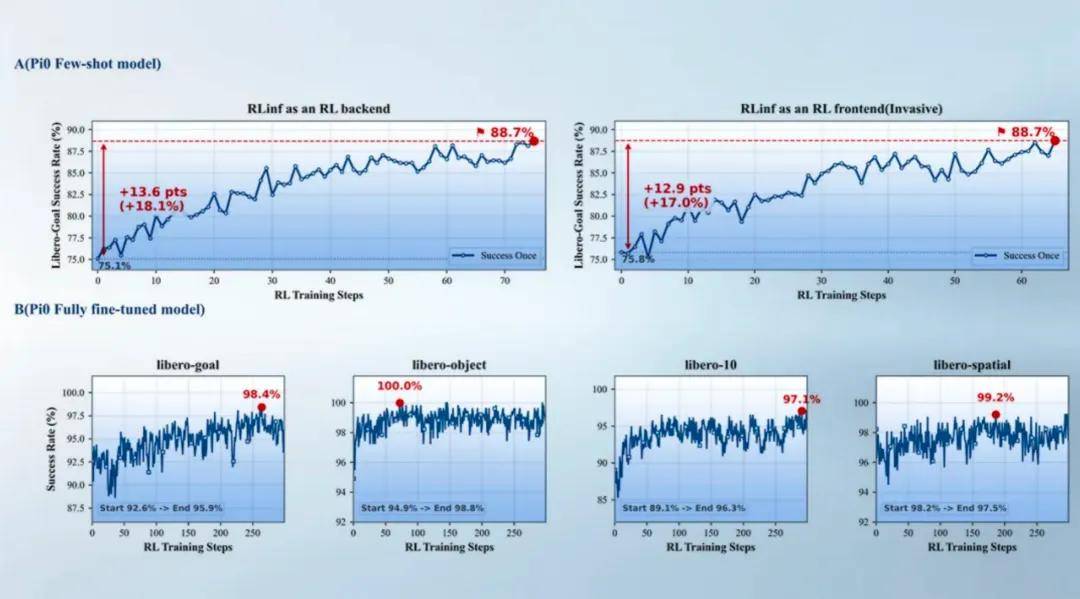

更重要的是,Dexbotic 通过后端适配器完整复用了 RLinf 原生的分布式能力,包括 Cluster、HybridComponentPlacement、Actor/Rollout/Env Worker 组以及 EmbodiedRunner。目前,该整合已在 LIBERO 系列任务套件中完成端到端验证,可支持 PPO 等算法完成后训练。对开发者来说,这意味着从模型开发、SFT Checkpoint 管理,到 RL 配置编写与任务启动,终于可以在同一个开发流中自然完成。

如果说大语言模型时代的黄金范式是「预训练 + SFT + RLHF」,那么在具身智能时代,「VLA 预训练 / SFT + 大规模 RL 后训练」正在成为新的模型进化路径。Dexbotic × RLinf 的打通,正是这一范式走向具身智能 PyTorch 的重要一步。

架构重塑

V-L-A 模块化解耦与多源混训

在复杂的物理世界中执行任务,机器人需要同时具备三种能力:敏锐的视觉感知、强大的逻辑认知、以及精细的运动控制。在过去,这三者往往被杂糅在一个极其厚重的黑盒网络中,不仅训练成本高昂,且任何单一模块的改进都需要对整个系统进行重构。

Dexbotic 2.0 直击这一痛点,在业界率先实现了 V(Vision Encoder,视觉编码器)、L(LLM,大语言模型)、A(Action Expert,动作专家)的彻底模块化解耦。

这种「乐高式」的架构设计,带来了前所未有的工程弹性:同一套系统可以在感知、认知和控制三个层面进行独立升级、自由替换与混搭。这意味着,算法工程师可以轻松地将最新的视觉基座接入原有系统以测试空间感知能力的提升,或者更换不同的动作头(Action Head)以适配不同自由度的机械臂。这种符合软件工程「开闭原则」的设计,为快速试验新模型提供了极大的便利。

在解耦的基础上,Dexbotic 2.0 带来了其最具战略意义的训练特性:多源数据混合训练(Co-training)。

传统的具身模型训练往往面临一个两难困境:纯互联网数据缺乏物理世界的操作语义,而真实的机器人轨迹数据又极其稀缺且难以覆盖长尾场景。Dexbotic 的解法是,用同一套训练过程,让模型把「看懂世界」和「动手操作」一起学会。

具体而言,视觉 - 语言模型(VLM)同时摄入多模态互联网数据(图像 / 视频 + 文字)与机器人实操轨迹。在互联网数据上,模型学习三类通用泛化能力:对场景生成精确描述(Caption)、将宏大指令拆解为可执行子步骤(Subtask),以及将自然语言锚定到三维空间中的具体对象(Grounding)。在此基础之上,动作专家(Action Expert)接入系统,将上述高维语义理解直接转化为连续的物理控制序列(如抓取、移动、放置)。

在最新的更新中,Dexbotic 甚至进一步支持了 CogACT 与 Pi0.5 模型的 Co-training(Action Expert + LLM 联合优化)能力。互联网海量数据赋予了模型「通用语义理解」,具身轨迹数据赋予了模型「可落地的操作技能」—— 两者的联合优化,使得机器人真正做到了「能说清、能看准、能做对」。

工程破局

SFT + RL 的黄金范式与单一入口设计

在大模型(LLM)的发展历程中,SFT(监督微调)让模型学会遵循指令,而 RLHF(基于人类反馈的强化学习)则让模型的能力上限与人类对齐,两者结合铸就了 ChatGPT 的辉煌。同理,在具身智能领域,「VLA 预训练 / SFT + 大规模 RL 后训练」正在成为公认的黄金进化范式。

然而,长期以来,具身 RL 的工程落地堪称灾难。研究者必须在两个独立的开源项目间「来回奔波」:在 Dexbotic 等框架中完成 SFT 训练拿到模型权重后,需要手动切换到复杂的 RL 框架仓库,重新编写任务配置、路径适配与数据接口。这种人为割裂的流水线,不仅导致了极高的认知负荷,也让代码维护成本急剧上升。

为了打破这一桎梏,Dexbotic 与顶级强化学习框架 RLinf 达成了深度战略合作,并在工程层面实现了教科书级别的融合。

开源具身智能原生框架 Dexbotic 宣布,正式支持以 RLinf 作为其分布式强化学习后端。此次整合的首要原则,依然是「乐高式架构」所体现的清晰边界:

Dexbotic 稳守前端本职:继续深耕机器人策略定义、模型注册、Checkpoint 管理、专属数据变换与用户侧实验入口;RLinf 稳守后端底座:承担分布式 Rollout、优化、Worker 调度、日志记录与 Runner 编排。

双方拒绝了粗暴的代码融合(Fork 强行揉合),而是实现了模块化拼装。结果是惊人的:开发者无需在两个仓库间跳转,只需停留在 Dexbotic 项目内,通过一行极其简洁的命令,即可启动完整的 RL 后训练流程。进阶用户依然可以通过 Hydra 灵活覆盖底层配置。

更重要的是,通过后端适配器,Dexbotic 完整复用了 RLinf 原生的强大分布式 RL 能力(包括 Cluster、HybridComponentPlacement、Actor/Rollout/Env Worker 组等)。这意味着,Dexbotic 策略终于拥有一套可调、可训、可增益的后训练闭环,模型的动作质量与执行成功率得以持续跃升。

此外,Dexbotic 近期还正式支持了基于 GRPO(群体相对策略优化)的模型后训练。该方案不依赖庞大的 Ray 框架,部署更加轻量,却能实现环境多卡并行推理与点对点数据均匀分配,让 RL 训练吞吐量大幅提高,帮助机器人从「能做」跨越到「更稳定地做好」。

「各司其职,是最好的协作。」Dexbotic 不隐藏、不替代 RLinf,而是为其提供最自然的承接入口。当具身智能进入「持续进化」时代,工程栈的协同能力正成为核心竞争力,而 Dexbotic × RLinf 的牵手,无疑树立了行业的标杆。

基础设施

从数据、仿真到真机的完整闭环

如果说算法与架构是具身智能的大脑,那么数据流转与硬件验证机制则是支撑其运作的骨骼与血液。Dexbotic 2.0 系统性地标准化了具身开发的生命周期,从「数据 — 训练 — 评测 — 硬件」四个环节构建了无缝闭环。

在数据引擎层面,框架提出了极简且高效的 DexData 统一数据格式。该格式创造性地将 Prompt、子任务拆解、目标物体 3D 框选以及机械臂 2D/3D 轨迹信息整合于一体,大幅压缩了多源数据对齐的工程开销。

在评测基准层面,Dexbotic 展现出了强大的生态包容力。在仿真端,通过高度封装的 Docker 环境,框架一口气适配了 5 款主流物理仿真器,并将所有仿真训练数据一键转化为 DexData 格式开源至 Hugging Face,彻底扫清了「复现不公平」的科研障碍。在真机端,Dexbotic 更是直接打通了全球首个具身智能大规模真机评测平台 RoboChallenge 的评测接口,并进行了全面开源代码贡献,让「开发 - 训练 - 推理 - 评测」的链路在物理世界中真正落地。

在最新前沿探索上,近日 Dexbotic 再下一城,新增对 UniNaVid 开源项目的深度支持。这不仅囊括了评测与 SFT 训练能力,还完成了 DexDataset 数据格式的适配,一举打通了导航任务从数据接入、模型微调到 Benchmark 评测的完整链路,为 VLN(视觉语言导航)与 Embodied Navigation 领域的持续迭代铺平了道路。

在硬件支持层面,Dexbotic 从未停止扩展的脚步。在已有的 ALOHA、UR5、Franka、ARX5 阵营外,框架不仅加入了星海图 Galaxea R1,还极具前瞻性地接轨了 NVIDIA GR00T N1,加速人形机器人的训练部署。更值得一提的是,原力灵机推出了完全开源的硬件产品 Dexbotic Open Source - W1 (DOS-W1) 与 SO-101,并全面适配了 XLeRobot 生态。以 DOS-W1 为例,其设计图纸、BOM 表与组装代码全面公开,大量采用的快拆结构与符合人体工学的抗疲劳设计,极大地降低了数据采集的门槛与设备维护成本。

巅峰验证

DM0 —— 全球首个从零训练的具身原生大模型

检验一个底层框架是否足够强大的最好方式,是看它能孵化出怎样的前沿模型。2026 年 2 月,基于 Dexbotic 框架研发的 DM0 大模型震撼发布。

作为全球首个从零开始训练的具身原生大模型,DM0 在权威真机评测基准 RoboChallenge 上,以 2.4B 的参数规模,一举夺得单任务与多任务双项第一,成功登顶全球榜首。

DM0 的成功,是对 Dexbotic 框架优势的极致展现。其展现出的极高「智能密度」,得益于预训练阶段对操作、导航、全身控制三类核心任务的系统级混合。DM0 的训练数据覆盖了 UR、Franka 等 8 种构型迥异的机器人硬件,在强大的框架调度下,模型被迫去学习底层的、通用的「物理操作逻辑」,而非死记硬背特定硬件的运动学参数,从而获得了令人瞩目的跨机型泛化能力。

更令人惊叹的是,依托 Dexbotic 的多模态数据处理能力,DM0 构建了独创的「空间推理思维链(Spatial Reasoning Chain-of-Thought)」。模型能够将环境感知、任务理解、运动规划与精细执行进行逻辑串联,完成诸如「先寻找目标、移开遮挡物、再进行拍照发送」这类需要长程多步骤空间推理的广义复杂动作。

持续迭代

半年的生长,千人的共建

自 2025 年 10 月发布以来的短短数月,Dexbotic 展现出了令人侧目的演进速度:

2025-10-20:Dexbotic VLA 代码库开源,提出数据、模型、实验三大核心层级;2025-12-29:全面适配支持 Pi0.5 与 OFT 模型,解锁其开发全链路;

2026-01-08:快速跟进硬件迭代,发布适配 Blackwell GPU 架构的专用镜像;

2026-01-15:NaVILA 导航算法、SimpleVLA-RL 合入主线,推出 GRPO 轻量级后训练方案;

2026-02-10:官宣与 RLinf 战略合作,打造具身智能的 PyTorch,发布登顶全球的 DM0 模型;

2026-03-30:硬件生态爆发,适配 XLeRobot、接入 NVIDIA GR00T N1,并为 Pi0.5 开启一键混训功能;

2026-05-09:全面兼容 UniNaVid,将版图强势扩张至泛具身导航领域。

高频的迭代带来了极其繁荣的生态回馈。目前,Dexbotic 已经成功服务了包括清华大学、北京大学、普林斯顿大学、帝国理工学院在内的数十家顶尖高校,以及腾讯、北京具身智能机器人创新中心等头部产业机构,累计触达研发者超过千人。

正如 Linux 之父林纳斯・托瓦兹所言:「软件进化需要群体的智慧。」

Dexbotic 拒绝了「闭门造车」的技术路线,而是选择将自己打造为具身智能领域的「基础运行层」。随着原力灵机、清华大学、无问芯穹等多方力量的持续汇聚,一个属于具身智能的繁荣开源生态正在形成。

当「大模型 + 机器人」从实验室的概念走向千行百业的真实场景,工程框架的协同演进能力,已经成为与模型算力同等重要的竞争维度。从解决数据格式的细枝末节,到重塑 SFT+RL 的顶层研发闭环,Dexbotic 的每一步更新,都在为通用智能机器人的到来夯实基建。

毫无疑问,具身智能的「PyTorch 时刻」已经开启。而 Dexbotic,正致力于成为承载这一历史进程的坚实基石。

欢迎全球研究者与开发者关注、Star,并共同参与 Dexbotic 社区建设,探索具身智能的无限可能。

项目官网:https://dexbotic.com/GitHub 开源仓库:https://github.com/dexmal/dexbotic

Hugging Face 模型集:https://huggingface.co/collections/Dexmal/dexbotic