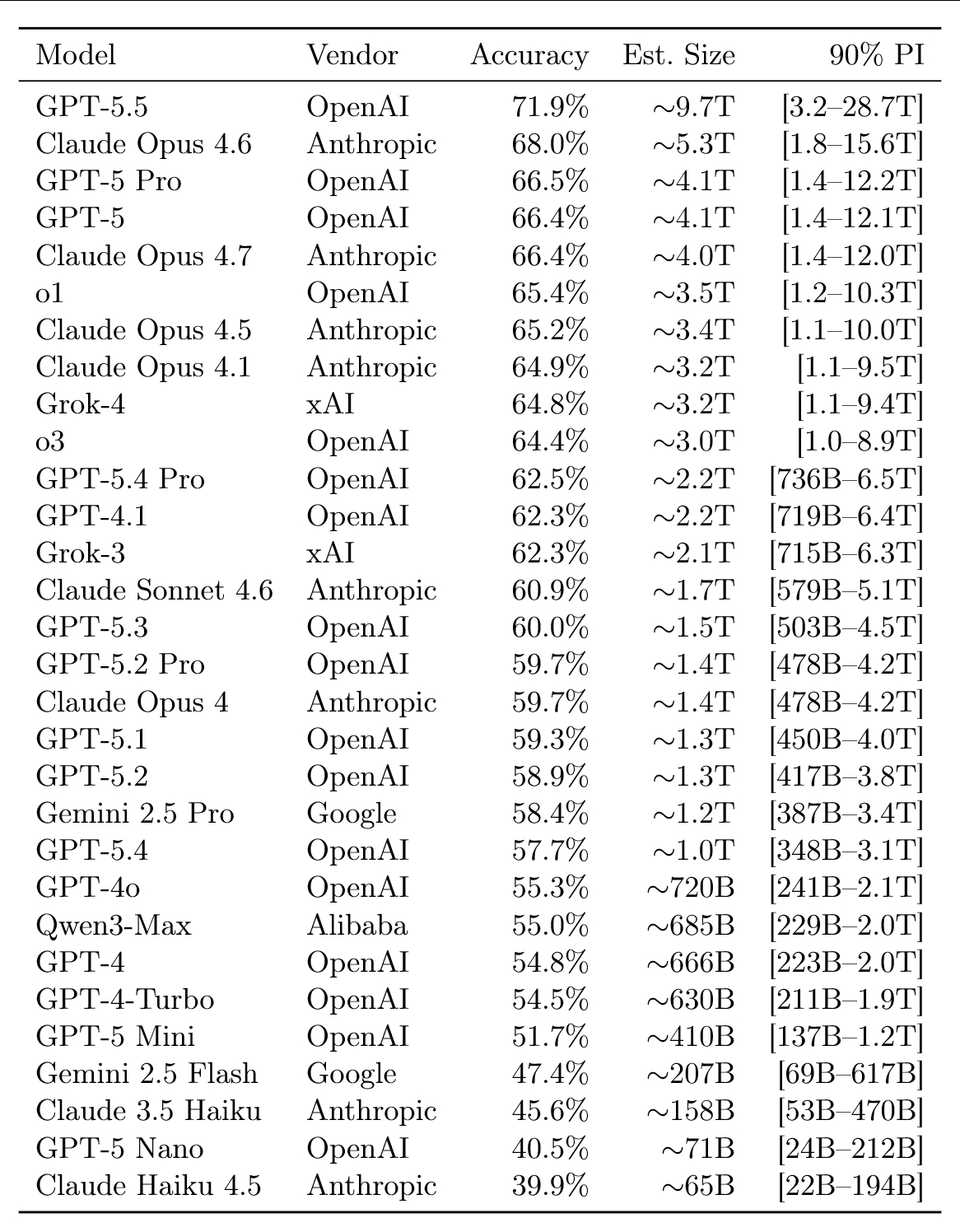

GPT5.5的参数已经到10T这个量级了?刚在那里看到的一篇推测闭源大模型参数的论文。地址:arxiv.org/pdf/2604.24827

原理大概是这样的:大模型对冷门事实,比如很小众的人名、地点、作品关系,不能靠逻辑推出来,只能靠模型在训练中“记住”。 所以论文先拿一批已知大小的开源模型做测试,看它们能答对多少冷门事实,并建立“答对率 ↔ 参数规模”的经验曲线;之后再把同一套题拿去问 GPT、Claude、Gemini、Grok 等闭源模型,如果某个模型的冷门事实答对率接近一个 1T 参数开源模型,就推测它有大约 1T 级别的“事实记忆容量”。当然这个方法准确性不可能很高,只能估数量级。一个1T的模型,它估算的参数可能落在0.33T 到 3T之间。AI创造营