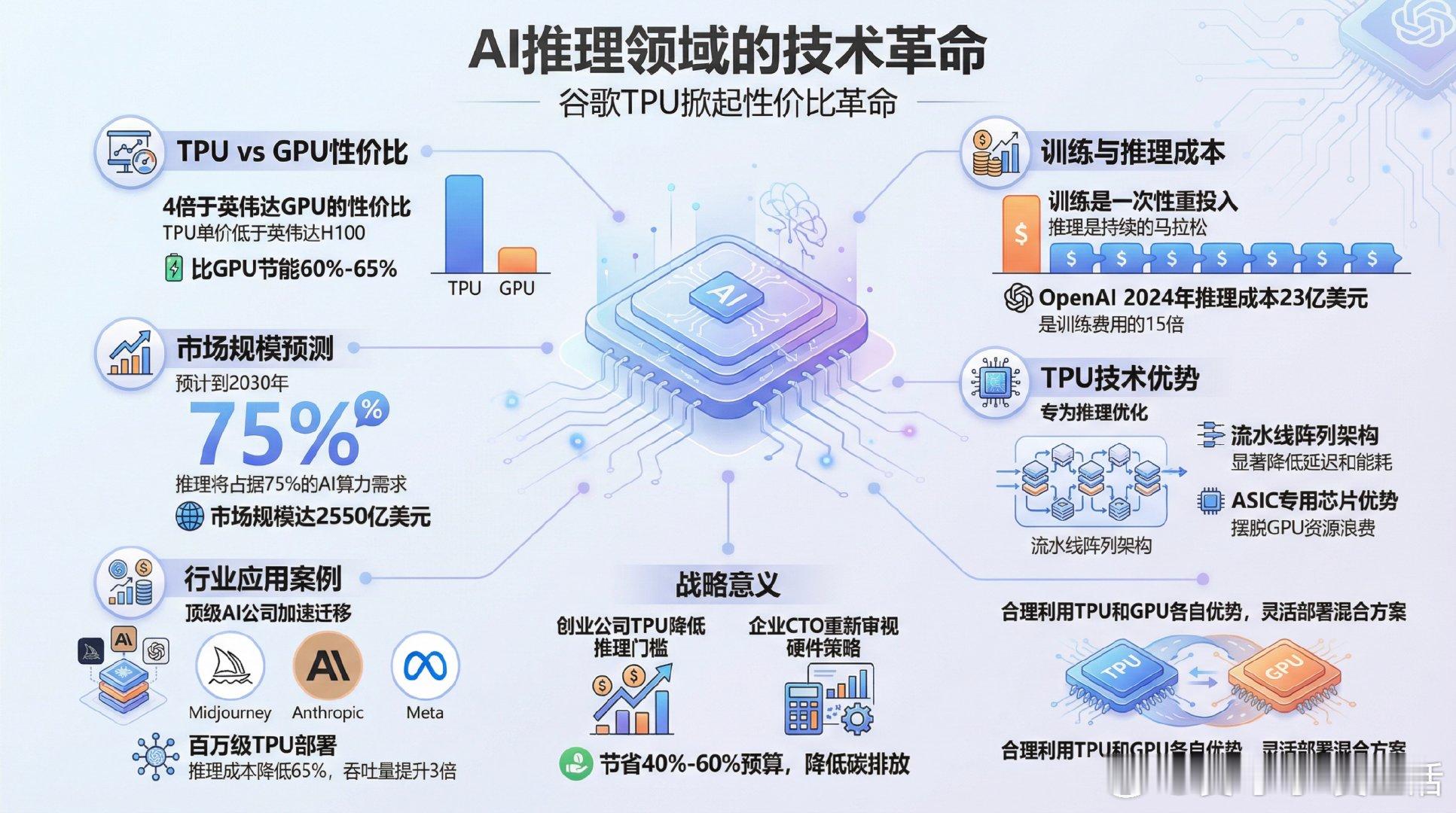

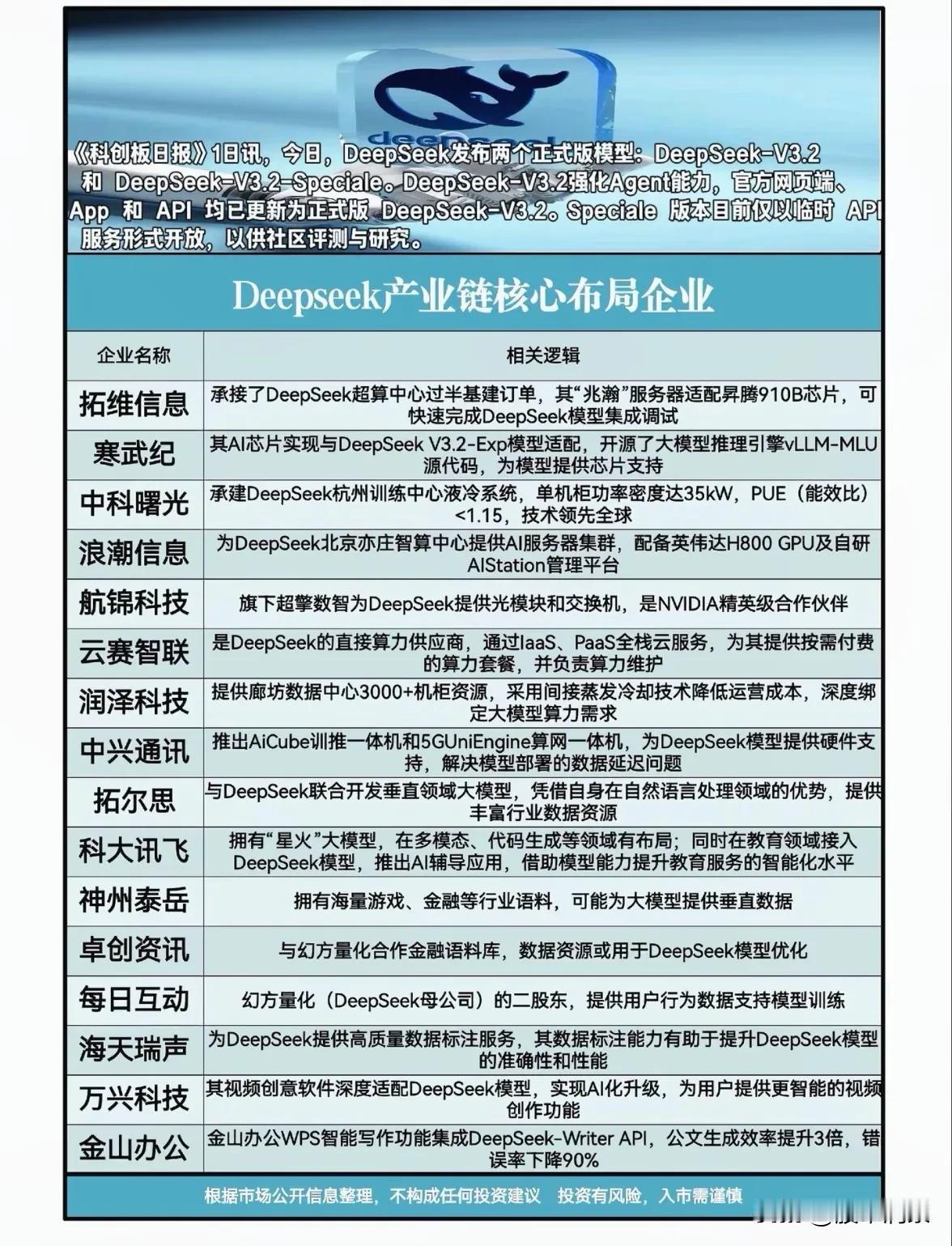

在AI算力竞赛中,训练阶段一直是Nvidia GPU的天下,但未来的焦点正快速转向推理(Inference)。推理成本远超训练,且呈指数增长,预计到2030年将占据AI算力75%,市场规模达2550亿美元。面对这一趋势,谷歌专为推理设计的TPU凭借4倍于Nvidia GPU的性价比优势,正引领行业巨头大规模迁移。Midjourney切换到TPU后,推理成本下降65%;Anthropic投入数十亿美元采购百万TPU,已用TPU驱动其Claude模型;Meta计划2026年起大规模采用TPU,结合GPU形成训练+推理混合架构。这些案例证明,TPU在成本、效率和能耗上均有显著优势,尤其在大规模、持续推理任务中节省40%-65%预算,并大幅降低数据中心能耗。为何TPU胜出?核心在于ASIC(专用集成电路)与GPU(通用图形处理器)的本质差异。GPU多功能但效率有限,推理时资源浪费严重;TPU专注张量运算,采用流水线结构和垂直供电,能耗降低60%,推理延迟更低,性能价格比高达4倍。正因如此,推理时代必然由TPU等ASIC主导。然而,TPU的生态尚需完善,目前主要绑定TensorFlow和JAX,部署多依赖谷歌云;GPU仍具训练多样性和跨云灵活性优势。未来企业将采用“GPU训练+TPU推理”的混合策略,实现成本与灵活性的平衡。投资视角也随之变化。Nvidia虽仍占80%市场,但推理市场被TPU蚕食,利润空间受压。华尔街巨头纷纷减持Nvidia股票,预示其AI帝国正面临深刻调整。AI从业者则应加速掌握TPU优化技能,未来人才需求和薪资优势显著。面对推理成本15倍于训练的现实,企业若不尽早布局TPU,将被成本压力拖垮,竞争力大幅落后。推理革命已然来临,优化推理架构将是AI基础设施的关键制高点。原文:ainewshub.org/post/ai-inference-costs-tpu-vs-gpu-2025